Liste de partage de Grorico

Liste de partage de Grorico

A l'université de Washington, une équipe peaufine depuis plusieurs années un logiciel, baptisé Photo Tourism, capable de traiter un grand nombre d'images récupérées sur le Web pour construire des v...

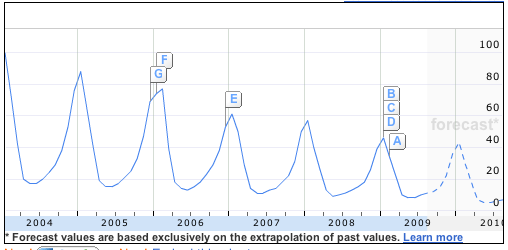

Yoosi Matias, Niv Efron et Yair Shimshoni, chercheurs aux Google Labs d’Israël travaillent sur Google tendance de recherche, l’outil qui permet d’accéder aux pratiques de recherches des utilisateurs du moteur. Comme ils l’expliquent dans un billet sur le blog de Google Research, l’évolution de certaines requêtes sont très saisonnières, comme la recherche “ski” liée à l’hiver, ou celles autour du basket-ball liée aux matchs. “Lorsque l’on regarde les tendances de l’ensemble du volume de recherches liées à des catégories particulières, on observe des habitudes régulières dans certaines catégories”… Des tendances assez prévisibles qui finissent même par se répéter d’année en année. Bien sûr, ceci n’est pas valable pour toutes les catégories : les tendances sont très irrégulières et difficiles à prévoir, notamment en ce qui concerne des requêtes liées à des évènements, des personnalités ou de l’information.

On comprend vite l’intérêt de pouvoir établir des estimations des tendances de recherches à venir, comme l’a montré le travail d’autres chercheurs de Google sur la grippe aviaire. Quelles sont donc les requêtes qui sont les plus prévisibles ? Quelles sont les thématiques les plus prévisibles et comment se fait la distribution de la prévisibilité entre les différentes catégories ?

A ce jour, le travail des chercheurs (.pdf) montre que :

- plus de la moitié des requêtes les plus populaires de Google sont prévisibles sur une période de 12 mois, avec un taux d’erreur moyen de 12 % environ. Et à contrario, bien évidemment près de la moitié des requêtes les plus populaires ne sont pas prévisibles.

- Certaines catégories sont particulièrement prévisibles (la santé, l’alimentation et la boisson, les voyages…), alors que d’autres le sont beaucoup moins (le divertissement, les communautés en ligne…).

- Les tendances de requêtes agrégées par catégories sont plus prévisibles qu’isolées.

- Il existe un lien évident entre la prévisibilité et la saisonnalité pour de nombreux types de requêtes.

- L’intérêt est de montrer à la fois la réalité des requêtes et le niveau de prévision de la méthode utilisée, car tout se joue dans les écarts.

Comme souvent avec Google, le modèle a été jugé suffisamment pertinent pour qu’il soit dès à présent intégré à Google tendance de recherche. Quand vous faites une requête, vous pouvez désormais avoir accès aux prévisions de recherches sur ce terme pour les 12 prochains mois.

Image : La requête ski dans Google Trends avec les tendances de requête à venir sur ce terme.

Comprendre la chaine alimentaire

L’algorithme de Google peut d’ailleurs servir à bien d’autres choses, comme le raconte Wired. Les scientifiques savent depuis longtemps que la chaîne alimentaire et les interactions entre espèces sont des éléments clefs dans la compréhension des facteurs qui président à l’extinction des espèces. D’où l’idée de Stefano Allesina, écologiste à l’université de Californie, et Mercedes Pascual de l’université du Michigan, d’adapter l’algorithme de Google, le célèbre PageRank, à la chaîne alimentaire, comme l’explique leur article publié dans PLoS. L’idée était de répondre à la question : quelle extinction d’espèce, dans un réseau alimentaire, pouvait conduire à la plus grande réaction en chaîne ?

L’algorithme de Google permet de prendre en compte les connexions entre espèces, mais aussi leur importance relative. “Ce que nous avons prouvé c’est que l’importance d’une espèce peut être connectée à la quantité de matière qui s’écoule d’eux”, explique Stefano Allesina. “Si une espèce mange beaucoup de choses et que beaucoup de choses la mangent, elle tend à être importante.”

La plupart des défenseurs de l’environnement concentrent leur action et leur étude sur une seule espèce. Or il faut tenir compte du fait que les espèces sont interdépendantes et qu’elles sont empêtrées dans un réseau d’interaction multi-espèces. Pour les écosystèmes sur le point de s’effondrer, comme les environnements marins mis en périls par la surpêche, Allesina affirme qu’une approche réseau pourrait faire toute la différence dans les politiques de préservation à mettre en place.

algorithmie, réseauxLe Cloud computing suscite de nombreuses craintes, aussi bien des

particuliers que des entreprises. Les dangers du modèle, quant à la maîtrise de

nos données hébergées dans le nuage, commencent à rencontrer un certain écho.

Google a besoin de rassurer sur ce point, pour convaincre les utilisateurs de

leur confier leurs données. Et comme souvent, don't be evil

oblige, il

répond en se plaçant sur le plan de l'ouverture, via un Front de Libération des

données.

La firme a constitué une équipe autour de Brian Fitzpatrick chargée d'améliorer les fonctionnalités d'import-exports de ses différents produits, et vient d'ouvrir un site, The Data Liberation Front[1] pour centraliser les informations sur le sujet. Le but est de permettre aux utilisateurs de récupérer leurs données pour pouvoir s'ils le désirent changer de fournisseur. Cela n'a rien de suicidaire. Si hier, le modèle était à l'assujettissement des utilisateurs entre autre via des formats propriétaires et fermés - certains ont bâti un empire là dessus - le futur est à l'ouverture et à ceux qui l'auront compris. Et savoir qu'on peut partir est souvent suffisant pour convaincre de rester.

Le site est donc en ligne et propose de courtes documentations sur les méthodes d'export, mais aussi d'import, d'une vingtaine de services maison (Blogger, Calendar, Gmail, YouTube...) Il y a encore quelques couacs, par exemple la page concernant YouTube indique qu'on peut télécharger ses propres vidéos en MP4 depuis l'interface d'administration, mais la documentation du service en lien précise que cette fonctionnalité est limitée à 2 vidéos par heure.

Ce premier pas, quelles qu'en soient les motivations, est louable, car non seulement il va dans le sens d'une plus grande ouverture, mais il va obliger les autres acteurs à s'aligner. Et en offrant des cas concrets, il soulève de nouvelles question, permet de pousser plus loin la réflexion sur la gestion de nos données.

La question la plus évidente est celle du format de sauvegarde, comme le reconnaît Brian Fitzpatrick dans un entretien sur le site du Guardian. Certaines données peuvent facilement être exportées dans des formats standards, ODF par exemple pour Google Doc, ICS pour Calendar, etc. Mais pour d'autres il n'existe pas encore de format. Comment enregistrer localement une "Wave", comment la réutiliser ?

De son côté, Ragavan Srinivasan, un ingénieur des Laboratoires Mozilla qui travaille sur le projet Weave soulève plusieurs points intéressants :

- pouvoir exporter ses données pour changer de prestataire est très bien. Mais est-il possible d'effacer nos données des serveurs de Google, et surtour comment avoir la certitude qu'elles l'ont bien été ?

- quid des méta-données, des informations dont on a enrichi nos données. Par exemple, si on peut récupérer toutes les vidéos mises en ligne sur YouTube, il ne semble pas encore possible de sauvegarder également les mots clés qu'on leur a associés;

- quid des données implicites ? c'est à dire des données que nous créons dans toutes nos intéractions avec Google ? Nos historiques de recherche par exemple. Sera-t-il possible de les exporter ?

Et cela m'amène à me poser d'autres question, en particuliers sur la propriété de certaines données. Si celles que nous créons explicitement nous appartiennent, qui est propriétaire des fameuses données implicites du Web² ? A qui appartiennent toutes les informations collectées par Google sur moi ? En suis-je l'auteur ? ou est-ce Google qui les crée en formalisant mes mouvements sous forme de données ? Qu'en est-il encore des données créées collectivement, un wiki, une discussion, etc. Sur Blogger, on peut exporter ses propres billets avec leurs commentaires, mais en tant que commentateur est-ce que je peux sauvegarder l'ensemble de mes commentaires ? Est-ce que cela a un sens de les enregistrer sans leur contexte ? Brad arrivera-t-il à reconquérir Cindy ou lui préférera-t-elle Paf la girafe ?

Notes

[1] j'avoue que l'appellation me met un peu mal à l'aise, sans doute par excès de paranoïa. Certes, Google cherche à tout prix à avoir une image cool et tout particulièrement chez les geeks, qui sont souvent des commerciaux enthousiastes et bénévoles pour ses produits. La firme fait ainsi régulièrement des clin d'œil à la culture geek. Ce site pourrait en être un, mais je trouve qu'il en fait un peu trop. Le site lui-même, créé avec Google Sites, l'appelation et le logo, cautionnés par une référence aux Monty Python. Difficile de croire à un simple humour potache de la part d'une société maîtrisant autant sa communication. Ce n'est sans doute qu'un moyen de faire du buzz. Mais cela peut aussi être vu comme un message signifiant que l'entreprise porte en elle sa contestation, histoire de désamorcer les critiques externes.

La technologie nous forcera-t-elle à choisir entre la vie privée et la liberté, comme l’affirmait David Brin dans son livre Transparent Society (Wikipédia) ?

Il n’y a pas ou plus, d’un côté des données personnelles et de l’autre des données qui ne disent rien des individus : un très grand nombre de données apparemment anonymes peuvent acquérir un “caractère personnel”, c’est-à-dire aider indirectement à savoir quelque chose sur un individu précis. Les champs de données permettent de plus en plus d’identifier leurs émetteurs, tant et si bien qu’on peut se demander à l’avenir si le concept de données anonymes a encore une pertinence. Si la directive européenne Inspire (Wikipédia, voir aussi le volet français) et la loi française sur la réutilisation des données publiques excluent explicitement du partage les données nominatives, force est de reconnaître que nous savons de moins en moins ce que sont des données nominatives. Car toute donnée est en passe de devenir une donnée à caractère personnel, comme le rappelle l’histoire des logs d’AOL qui avaient permis d’identifier plusieurs dizaines de personnes simplement en observant la liste des sites sur lesquels elles avaient surfé… Demain, des logiciels permettront d’identifier qui a écrit un texte en observant tout simplement la masse des écrits du web et proposeront des correspondances qui reposeront sur le style, le vocabulaire, la grammaire ou les tics de langages de chacun… De même, combien de temps les visages anonymes sur les photos que nous échangeons le resteront-ils, quand on regarde les progrès de la reconnaissance faciale… Par leurs seuls champs, des ensembles de données peuvent révéler des préoccupations qui vous sont propres. La régularité de vos passages anonymes sous des capteurs permet aussi de vous reconnaitre en croisant des données de déplacement avec d’autres issues de la masse des données chaque jour un peu plus disponible en ligne.

Bien sûr, “toutes” les données ne sont pas devenues personnelles (les horaires de transports, les données de capteurs environnementaux, les documents administratifs… par exemple), mais une masse considérable de données qui ne l’étaient pas a priori sont en passe de le devenir. D’autant plus que leur couplage, chaque jour plus facile, peut à chaque moment faire basculer des données “sans valeurs” en données à caractère personnel.

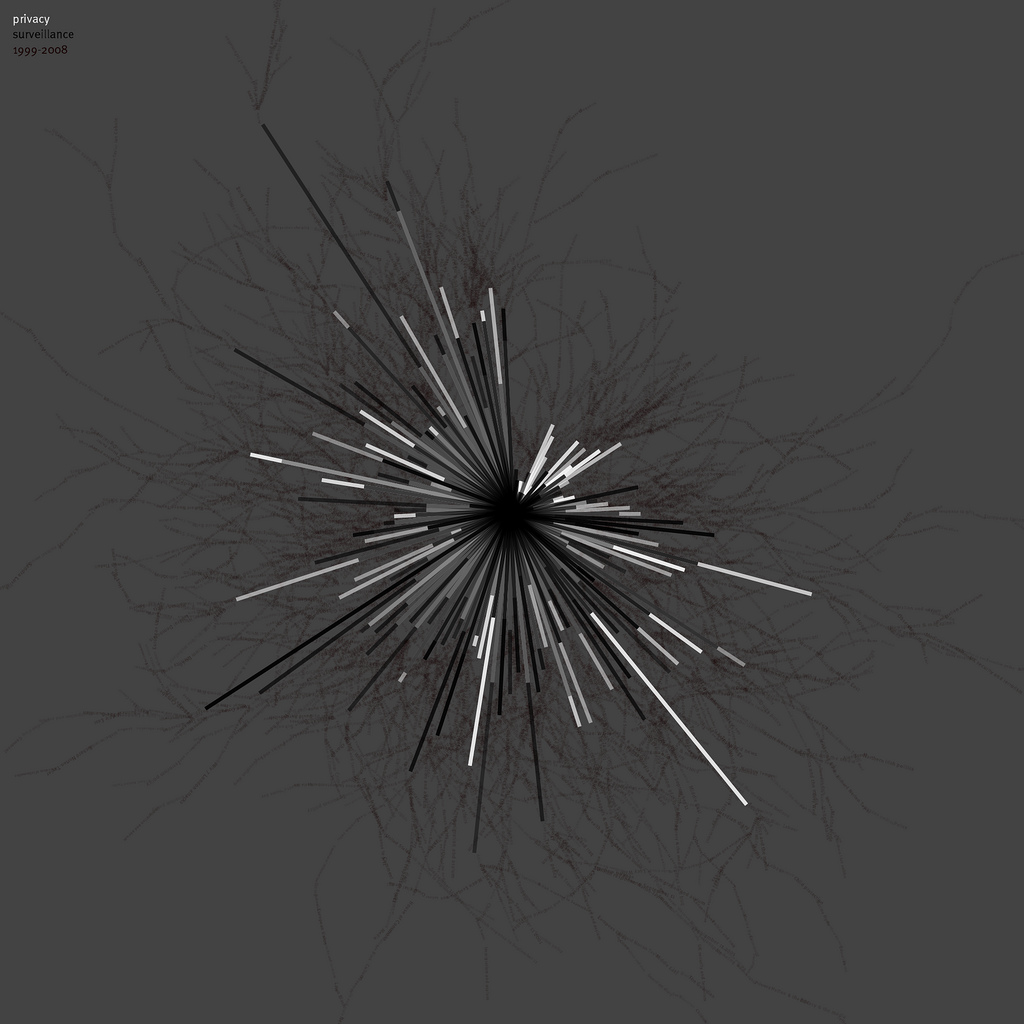

Image : Horloge de l’utilisation des termes “vie privée” et “surveillance” dans le journal The Guardian entre 1999 et 2008 (le graphique se lit comme une horloge, on commence par 1999 et on fini par 2008, le terme surveillance est en noir et vie privée en blanc) par blprnt alias Jer Thorp.

Peut-on réellement anonymiser des données ?

Au milieu des années 90, une commission d’un groupe d’Assurance américain décidait de publier des données médicales anonymisées d’employés de l’Etat du Massachusetts. Un étudiant en informatique, Latanya Sweeney, en demanda une copie et travailla à leur “réidentification”. Le gouverneur du Massachusetts assurant que l’organisme d’assurance avait protégé chaque patient en effaçant tous les identifiants nominatifs, Sweeney utilisa les listes de votants de la petite ville où habitait le gouverneur et croisa les deux bases de données. Seulement 6 personnes dans cette ville partageaient les mêmes dates de naissance, seulement 3 étaient des hommes et un seul partageait le même code postal… que le gouverneur. L’informaticien envoya au gouverneur tout son dossier médical.

Cette histoire que raconte Nate Anderson pour Ars Technica montre bien que l’anonymisation à une époque où les données sont démultipliées n’est plus si simple. Quelques années plus tard, Latanya Sweeney démontra d’ailleurs que 87 % des Américains pouvaient être identifiés uniquement à partir de 3 informations : le code postal, la date de naissance et le sexe.

Toute information peut devenir personnelle quand elle se combine avec suffisamment d’autres données. Dans un récent article sur “l’étonnant échec de l’anonymisation”, Paul Olm, de la faculté de droit de l’université du Colorado, explique qu’avec toute l’information que nous disséminons en ligne, nettoyer les données des identifiants les plus évidents ne suffit plus. Ré-identifier ou dé-anonymiser des données se fait le plus souvent avec une étonnante facilité. “La science de la ré-identification bouleverse le paysage politique de la confidentialité en sapant la foi que nous avons placée dans l’anonymat”, écrit Ohm.

Parce que la plupart des lois sur la confidentialité des données mettent l’accent sur la restriction des informations personnelles identifiables, il faut maintenant les repenser, avance-t-il. Pour Ohm, il est plus approprié de penser l’identifiabilité comme un continuum : c’est-à-dire d’observer les champs de données dans leur capacité à générer de l’identifiabilité. La notion de données anonymisées devient alors problématique, car le code par lequel on remplace des données permettant l’identification ne remplace pas le caractère identificatoire de ces données… Et il n’y aura pas de solution miracle prévient Ohm : les mesures qui sont prises augmenteront la confidentialité ou réduiront l’utilité des données, mais il n’y aura aucun moyen de garantir à la fois une utilité maximale des données et une confidentialité maximale.

Il ne suffit pas de ne plus enregistrer le numéro de sécurité sociale ou les noms et adresses des gens. Une partie de l’historique de vos recherches sur internet suffit à vous identifier, des informations sur les déplacements d’un véhicule permettent d’identifier son conducteur… Car les informations personnelles identifiables sont une catégorie en expansion constante : il y a dix ans, personne n’aurait classé des critiques d’internautes sur des films (1) ou des requêtes de recherche dans cette catégorie. Ce qui explique qu’aucune loi ne l’ait pris en compte. Mais on comprendra vite que développer des règles de confidentialité à chaque fois qu’une technique de réidentification nouvelle se développera entraînerait une escalade législative à laquelle il serait impossible de répondre.

La distinction binaire et traditionnelle entre les données à caractère personnel et les autres devient difficile à maintenir. Des données présentées comme anonymes ne le sont souvent pas du tout, prévient l’Electronic Frontier Foundation dans un billet tendant à définir ce qu’est une information à caractère personnel. “Etant donné le nombre de variables qui permettent de nous distinguer, nous sommes bien plus différents les uns des autres que nous nous y attendions, et il y a plus de sources de données que nous le pensons qui peuvent être utilisé pour préciser exactement à qui fait référence un enregistrement particulier”

Quelles intimités le partage libère-t-il ?

Alors, certes, la “libération” des données permet d’imaginer beaucoup d’applications utiles et transformatrices, comme le décrivent très bien O’Reilly et Battelle. Mais très vite, des questions importantes se poseront sur la nature de ces données, leur propriété, leurs effets collatéraux, et donc la légitimité de leur “libération”. Quelles sont-elles ? Comment et par qui sont-elles produites ? Quels champs renseignent-elles ? De quoi sont-elles composées ? A quel niveau de vie privée, d’intimité, permettent-elles d’accéder (ce qui suppose d’établir une grille des degrés d’intimité que les données révèlent selon les champs qu’elles proposent et imbriquent : il y a là assurément un vrai référentiel à construire) ? Qu’elles incohérences le partage libère-t-il, démultiplie-t-il ?

Souvent, les systèmes de capteurs conservent des données qui ne semblent pas indispensables à leur fonctionnement courant. Faut-il que notre système de télépéage ou notre pass Navigo conserve des données nominatives, permettant de savoir qui passe à tel ou tel portique ? A-t-il besoin de conserver nos lieux d’entrée et de sortie (alors que d’autres compteurs sont en place, comme les compteurs de passage aux barrières et aux portes) ? L’important, pour ces systèmes, c’est de savoir qu’un titulaire de droit à la possibilité de franchir la barrière, pas qui il est, ni à quel endroit il passe, ni où il va. Et surtout que se passe-t-il quand ces données-là peuvent être croisées avec des milliers d’autres ?

De quelle transparence ces données sont-elles porteuses ?

Car c’est bien là l’enjeu ! Comme le remarque pertinemment Thierry Lhôte, le texte fondateur du Web² ne parle pas de liberté pas plus qu’il ne soulève une réflexion sur les possibilités d’atteintes à la vie privée par l’exploitation des données - et de pointer du doigt un intéressant édito de Saul Hansell pour le New York Times, qui s’étonne que l’administration Obama soit restée à ce jour si silencieuse sur la vie privée dans son programme technologique. De quelles transparences, de quelles autonomies libératrices, ces données sont-elles donc porteuses ? A quoi serviront-elles ? Quel est le but du Web² ?

Faut-il lire derrière l’absence de référence au caractère personnel des données un présupposé en faveur d’une “société de la transparence” ? Pas une transparence qui permet de mieux voir et comprendre les données, comme la défendent les tenants de la visualisation de l’information comme ceux qui animent le magazine Good.is. Mais cette transparence qui permet d’aller à la source des données. Cette transparence - cachée dans l’ombre informationnelle des données - est devenue la nouvelle objectivité, clame David Weinberger sur son blog. A l’heure du lien explique-t-il, le mécanisme de confiance change : on passe de l’objectivité à la transparence. La transparence permet de voir les sources et les valeurs qui mènent chacun à prendre la position qui est la sienne. Dans cette mécanique, les données sont la source et la valeur ultime.

Cette conception de la transparence n’est pas sans poser de nombreuses questions. Est-elle bénéfique ? Est-elle la seule réponse à une situation où protéger sa vie privée ne serait plus une option ? Est-elle à combattre et si oui, comment ? Peut-on s’appuyer sur la perspective du Web² pour imaginer rendre la transparence “réciproque” (on sait ce que les autres savent sur soi et ce qu’ils en font), voire même pour appliquer la transparence aux organisations sans nécessairement l’appliquer aux individus ?

Les données, pas plus que la technologie, ne sont neutres. Elles ne sont transparentes qu’en partie. Si l’on ne croit pas aux vertus de cette transparence, alors il y a incontestablement un enjeu à raréfier les informations produites : réduire la collecte, anonymiser et chiffrer, créer des processus d’effacement ou d’oubli…

Notre historique, notre activité, notre identité (jusqu’à quel niveau de précision ?) seront-ils toujours masqués dans notre ombre informationnelle ? Regarderons-nous vraiment les gens avec des lentilles qui nous rappelleront les informations qu’ils portent sur eux, les notes avec lesquelles les autres les étiquettent, à la manière de tous ces systèmes de réalité augmentée qui ont fleuri cet été ? Nos données seront-elles attachées sans cesse non seulement à notre existence numérique, mais également à notre existence physique ? Quelle sera leur capacité à oublier, à s’effacer, à disparaître comme les #hastags s’effacent dans Twitter - mais pas sur d’autres services comme hastags ? Pourrons passer facilement d’une identité l’autre, comme le propose élégamment le projet TAT (vidéo) ? Aurons-nous le droit d’en avoir plusieurs ? Pourrons-nous encore mentir ?

Hubert Guillaud

_________

1. Le fait de poster de simples avis sur des films peut aussi permettre de vous identifier, expliquent Arvind Narayanan et Vitaly Shmatikov. Quand Netflix, le loueur de films par internet américain, a rendu disponible sa base de données de recommandations de films - anonymisée la encore - pour lancer son concours d’amélioration de son moteur de recommandation, des scientifiques ont combiné ces données avec d’autres données de recommandation sur l’internet leur permettant de réidentifier un grand nombre de recommandations.

Je citais récemment de WebGL comme une des technologies du Web Libre. Quelques semaines après Webkit, une implémentation de cette spécification ouverte permettant de faire de la 3D dans un navigateur vient de faire son arrivée dans les versions de développement de Firefox, dans la branche qui devrait donner Firefox 3.7 au premier semestre 2010. Les principaux navigateurs modernes (Firefox, Chrome, Safari) devraient donc d'ici quelques mois permettre d'utiliser de la 3D nativement, sans avoir besoin d'installer un logiciel externe. Après la vidéo, c'est une nouvelle fonctionnalité qui se libère. Rapide lexique pour s'y retrouver dans ce nouveau monde.

WebGL est une implémentation d'OpenGL ES 2.0 utilisant JavaScript et Canvas. Les navigateurs peuvent ainsi afficher des contenus en 3D en profitant directement des mécanismes d'accélération matérielle des cartes vidéos. WebGL est une spécification en cours de création au sein du groupe Khronos.

Le groupe Khronos est un consortium réunissant de nombreuses entreprises dans le but de créer des standards ouverts dans le domaine du graphisme et du multimédia. Ces standards sont conçus en commun par les membres du groupe qui peuvent les implémenter sans devoir payer de licence. Le groupe compte aujourd'hui plus d'une centaine de membres, fabriquant de composants, de terminaux ou de logiciels. Il gère de nombreux standards comme OpenGL, OpenCL, et le récent WebGL.

OpenGL est une spécification définissant une API pour dessiner en 2D et 3D. C'est probablement la spécification la plus utilisée dans ce domaine. Elle est concurrencée par DirectX, technologie propriétaire développée par Microsoft. Le projet MESA fournit une implémentation libre d'OpenGL, qui peut fonctionner même si aucune accélération matérielle n'est disponible.

OpenGL ES est une déclinaison simplifiée d'OpenGL pour les systèmes embarqués (ES = embedded systems) comme les téléphones portables.

WebGL a été lancé en Mars 2009 par le groupe Khronos à l'initiative de Mozilla, afin de définir un standard pour utiliser de la 3D dans un navigateur. Cette initiative est probablement destinée à contrer le risque de voir chaque éditeur développer sa propre norme (par exemple Google propose O3D, Adobe a développé de nombreuses fonctions facilitant l'usage de la 3D dans Flash 10, etc). Un deuxième communiqué en Août précisait la direction prise : exposer les fonctions de l'API OpenGL ES 2.0 à JavaScript et utiliser la balise Canvas pour l'affichage. Une première version de la spécification devrait être disponible début 2010. Les membres du groupe de travail ont commencé à implémenter les brouillons afin d'aider à la finalisation. WebGL fonctionnera sur toutes les plate-forme disposant de pilotes supportant OpenGL et OpenGL ES. L'utilisation native de l'accélération matérielle des cartes graphiques combinée aux rapides progrès des performances des moteurs JavaScript devrait permettre d'obtenir dans les navigateurs un affichage proche des applications clientes classiques.

Canvas est une balise standardisée dans HTML 5. C'est une zone rectangulaire dans laquelle on peut dessiner au moyen de fonctions JavaScript. La balise a été initialement créée par Apple, mais est aujourd'hui disponible dans la plupart des navigateurs, soit nativement, soit en utilisant des bibliothèques qui l'émulent pour les navigateurs archaïques comme ceux de Microsoft[1]. J'avoue regretter que Canvas soit en train de prendre le pas sur SVG pour dessiner à l'intérieur du navigateur. Certes SVG est une norme particulièrement complexe, mais elle me paraissait plus prometteuse que Canvas (SVG est un dialecte XML, donc on peut facilement le parcourir, lui appliquer des modifications, etc. Pour ce qui est de Canvas, il est difficile de savoir ce qui est dessiné à l'intérieur).

Les utilisateurs de compilations nocturnes de Webkit pourront trouver

quelques exemples d'utilisation de WebGL ici.

Vous pouvez essayer de les faire fonctionner dans Firefox en remplaçant dans le

code canvas.getContext("webkit-3d") par

canvas.getContext("moz-webgl"). Pour connaître les fonctions

disponibles, le mieux pour l'instant est de consulter la documentation ultime,

le

code source. La spécification étant encore à l'état de brouillon, des

divergences entre les différentes implémentations existent qui devraient être

corriger dans les prochains mois. Pour suivre l'avancée du chantier dans

Firefox, je vous conseille les blogs de Vladimir Vukićević, qui expérimente depuis

plusieurs années l'utilisation de 3D avec Canvas, et de Mark Steele qui travaille sur

WebGL.

Les domaines d'application sont très nombreux : les jeux en ligne et les univers virtuels, bien sûr (on pourra bientôt avoir des "Second Life" qui s'exécuteront directement dans le navigateur, sans nécessiter l'installation de logiciels spécifiques), mais aussi sans doute les applications de réalité augmentée (car WebGL va apporter la 3D dans les terminaux mobiles).

Au final, voilà une belle avancée a qui un arrière goût de sur-place. Sur-place parce que je faisais déjà tourner des cubes en 3D sur mon premier micro-ordinateur il y a plus de 25 ans, et en 1996 BeOS projetait déjà des films sur des théière en 3D. WebGL n'est donc qu'une n+1ième implémentation de technologies depuis longtemps éprouvées. La réelle avancée est que cela se passe à présent à l'intérieur du navigateur, qui gagne de plus en plus ses galons de système d'exploitation à part entière. Et le tout en JavaScript, donc facilement bidouillable.

Ajout du 22 : Vlad vient de mettre en ligne une première démonstration.

Deux étudiants du MIT ont imaginé un outil capable de repérer sur la toile les personnes homosexuelles. Leur outil parcours les sites sociaux à la recherche d'indices comme les goûts musicaux, les choix politiques, les types d'amis, les réactions à l'information... afin de déterminer si les personnes ont une forte proportion de chance ou pas d'être homosexuelles. Leur propos, montrer comment on peut détourner le traitement de l'information que les internautes déversent sur le net.