Liste de partage de Grorico

Liste de partage de Grorico

Note: ce billet a été écrit au printemps, mais n'a jamais franchi le cap de la relecture car il ne me satisfaisait pas. Comme il a inspiré plusieurs autres divagations, je finis par le mettre en ligne, mais ça reste un brouillon, une maquette en cours, que je continuerai probablement à décliner quelque temps.

Plongée narcissico-temporelle, accrochez vos vaccins

J'ai eu la chance de vivre déjà deux périodes de démocratisation de l'informatique.

La première, au début des années 80, avec l'arrivée de la micro. Pendant

quelques années, tous les ordinateurs étaient livrés avec ce qu'il fallait pour

apprendre la programmation: un langage et des manuels pour apprendre. Sans

doute parce qu'au vu du faible nombre d'applications alors disponibles, il

fallait laisser les utilisateurs créer les leurs. Ou peut-être que pour les

pionniers de cette époque, il était évident que la première fonction d'un

ordinateur était d'être une plate-forme sur laquelle chacun et chacune pouvait

créer ce dont on avait besoin/envie. A moins que ce fût pour des raisons

marketing: en ce temps là, les adultes n'étaient pas encore des adulescents,

pour convaincre de l'utilité d'un ordinateur, apprendre l'informatique était un

argument qui marchait mieux que toute la famille pourra jouer à Mario

Kart

. Mais au final peu importent les raisons, on avait nos drôles de

machines, on avait Hebdogiciel et on passait notre

temps libre à découvrir, bidouiller, coder...

Puis peu à peu les applications disponibles sont devenues plus nombreuses, les langages de programmation plus complexes, moins accessibles. Pour rester au même niveau que les jeux commerciaux, il fallait se mettre à l'assembleur, pour les applications de bureau au C et découvrir les bibliothèques de composants graphiques. Parallèlement, les langages et environnement de programmation ont disparu des logiciels livrés par défaut avec la machine, sont devenus des trucs payants, et la programmation est redevenue une affaire de spécialistes. Fin pour moi du premier âge d'or.

Au mitan des années 90 est apparu le web, et avec lui un nouvel environnement, relativement accessible et simple à utiliser pour à nouveau créer. HTML est un langage fondamentalement ouvert, pour l'apprendre il suffisait de consulter le code source des pages, auquel tout le monde pouvait accéder. Pour coder, un simple éditeur de texte suffisait. Les différents langages de la pile étant interprétés, les résultats étaient immédiatement visibles, sans nécessiter de passer par une compilation. HTML était très simple à apprendre, ne nécessitait pratiquement aucune culture informatique. Rapidement des hébergeurs ont fourni à faible coût l'architecture permettant à chacun et chacune de créer son site perso, pas forcément de façon très heureuse, mais avec énormément d'enthousiasme. Côté serveur un langage de script simpliste est apparu quelques années plus tard, PHP. Il ne nécessitait lui aussi qu'un investissement minimal. Un éditeur de texte, un client FTP, et on pouvait commencer à rendre dynamiques nos sites. La documentation bien faite ― elle reste encore à ce jour une des principales forces de PHP ― et rapidement traduite dans de nombreuses langues a contribué au succès du langage. Nombre d'internautes sans aucune notion de programmation ont ainsi pu créer des sites en apprenant peu à peu HTML, JavaScript et PHP. C'est ainsi par exemple qu'est né SPIP.

Et à nouveau, au fil des années on a assisté à une professionalisation, on pourrait dire que le Web s'est refermé. Même si les technologies restaient les mêmes, le ticket d'entrée était de plus en plus cher. Qui veut avoir un site aujourd'hui se tourne vers une solution toute faite hébergée plutôt que de développer ou d'installer la sienne. Avec le Web dit "2.0", on crée des contenus, mais on ne maîtrise pas la fabrication des outils servant à les créer, on utilise une plate-forme devenue une boîte noire.

Bidouilleurs, saison 3

J'ai l'impression d'assister aujourd'hui à une troisième vague de démocratisation, via JavaScript et des outils comme Greasemonkey, Firebug, Ubiquity, Bespin, Jetpack. A nouveau, l'atelier est à la disposition de tous, fourni gratuitement en standard avec ce nouvel OS qu'est le navigateur. Une combinaison de touches, et on crée ses propres commandes, on manipule comme on le souhaite le Web, les données... Petit à petit, les outils se mettent en place pour qu'une nouvelle génération s'ouvre à la bidouille informatique. Mais cette fois-ci, l'enjeu me semble encore plus important. Compte tenu de la place qu'est en train de prendre le Web, avoir des rudiments de programmation me semble aujourd'hui une condition indispensable pour permettre aux individus de s'émanciper, de devenir acteurs et non simples consommateurs de leur vie.

Tous et toutes bidouilleurs !

Personne ne niera l'importance de savoir lire et écrire : c'est une condition indispensable pour comprendre le monde dans lequel on vit et pouvoir agir dessus, pour s'émanciper, devenir autonome et libre. Mais lire et écrire doivent être pris dans un sens plus large. Il ne s'agit pas que de caractères, mais de savoir déchiffrer le monde et le modeler. Comprendre et créer. Lire et écrire des livres, mais aussi des machines. Comprendre le fonctionnement d'un moteur et savoir en créer un, ou au minimum être capable de le bricoler, réparer, améliorer. Et c'est valable dans tous les domaines. Il en va également de notre rapport à nos outils et aux machines qui forment notre entourage : pour ne pas en devenir esclave, pour ne pas être aliénés, nous devons apprendre à les comprendre et savoir les bricoler. C'est valable pour une voiture comme pour un ordinateur. Il est essentiel de comprendre comment fonctionne un ordinateur et un logiciel, de savoir lire et comprendre sa recette (dans le cadre d'un logiciel, son code source), d'être au minimum capable de le bricoler, d'en corriger les erreurs, de l'améliorer. Nous pouvons et pourront à l'avenir de moins en moins nous passer de l'informatique et du Web. Il faut donc que chacun et chacune apprenne la programmation. Ou accepte de devenir esclave de la machine et de ceux qui la maîtriseront.

Dans ses présentations sur l'Open Web, Mark Surman dit souvent que tous les usagers doivent devenir des hackers. Il ne faut bien sûr par entendre ici hacker comme expert en informatique, mais plutôt comme bricoleur, bidouilleur. Pour bâtir un Web Libre, il faut non seulement développer et promouvoir des technologies libres et ouvertes, mais il faut aussi éduquer les usagers[1], les aider à ne pas être de simples consommateurs passifs mais à devenir acteurs de leur vie en ligne, les aider à devenir des bidouilleurs, des bricoleur du dimanche de Web. Heureusement, comme je le disais, les conditions permettant l'appropriation du Web par ses usagers commencent à être réunies, grâce notamment à l'éclosion de nouveaux outils.

Les outils à travers les âges

Les temps immémoriaux

D'après Aaron Boodman, un développeur du navigateur de Google, les trois quarts des extensions des plus populaires de Firefox servent à manipuler les données affichées, et non à ajouter de nouvelles fonctionnalités au navigateur. Ce qui tendrait à prouver que pouvoir manipuler à leur guise les données est un besoin fort des usagers. Or pour cela, nul besoin de créer une extension, ce qui reste complexe. Pour bidouiller des données, bien souvent de petits scripts s'exécutant dans le navigateur suffisent. Des solutions existent depuis longtemps, comme les bookmarklets, les scripts GreaseMonkey, ou Stylish pour la mise en forme. Ce sont des outils simples à prendre en main, un éditeur de texte suffit pour créer des scripts, mais ils manquent un peu de convivialité.

La révolution Firebug

Ensuite est né Firebug, et le Web n'a plus été le même. Firebug est un outil génial pour expérimenter, sans doute l'un des meilleurs. Car il inclut directement dans le navigateur des outils pour afficher la structure des pages, le HTML, les styles, le fonctionnement sous-jacent du réseau, étudier les scripts en en suivant le déroulé pas à pas. C'est l'outil indispensable pour étudier le Web, pour mieux le comprendre. Mieux, Firebug comprend, toujours à l'intérieur du navigateur, tout ce qu'il faut pour expérimenter : un éditeur et une console. On n'a plus besoin d'aucun logiciel externe. On tape des commandes, on commence à rédiger des scripts dans l'éditeur, le résultat est visible immédiatement dans la page, en direct, pas besoin de compiler, redémarrer ou quoi que ça soit, la console affiche des messages d'information ou d'erreur... Oui, cet outil est génial et il est grand temps qu'il ne soit plus réservé aux développeurs, car pour moi Firebug a un formidable pouvoir pédagogique : il permet d'étudier, comprendre, expérimenter. Pour être parfait, il ne lui manque à vrai dire que la possibilité d'enregistrer les scripts que l'on crée, de les transformer en commandes intégrées au navigateur.

Les Mozlabs à la rescousse

Les Laboratoires Mozilla l'ont bien compris, qui ont marié GreaseMonkey et Firebug pour le meilleur et deux superbes enfants, Ubiquity et Jetpack. Avec l'aide du cousin Bespin, qui est en cours d'intégration aux deux précédents, on disposera nativement dans le navigateur de tous les outils pour bidouiller et le Web et la plate-forme, Firefox : un éditeur moderne, avec tous mes mécanismes d'assistance nécessaire (coloration syntaxique, auto-complétion, détection d'erreurs de syntaxe à la frappe, etc); une ligne de commande intuitive qui permettra littéralement de dialoguer avec Firefox, et dans sa langue natale (en terme d'accessibilité au plus grand nombre, c'est indispensable); et des bibliothèques de haut niveau qui permettront d'effectuer des tâches complexes en quelques instructions (allez voir comme Jetpack simplifie le développement).

Envoi

Ce ne sont bien sûr que des outils, mais des outils qui créent des possibles, qui abaissent chaque jour davantage la barrière à franchir pour oser commencer à bidouiller le Web. Bricoler la toile devient chaque jour plus simple, plus accessible. Maintenant que les outils sont là, il faut bien sûr toujours des mécanos pour continuer à les améliorer, mais il faut aussi davantage d'évangélistes, de pédagogues, pour expliquer que la bidouille n'est plus une affaire de spécialiste, qu'elle est à la portée de chaque internaute. C'est aussi comme cela que j'entends le projet Drumbeat : faisons ronfler les Djembés pour faire sortir la bidouille du ghetto geek.

L'enjeu, je le répète, est de permettre à chacun et chacune de s'émanciper, de ne plus être esclave des machines mais de devenir autonome, libre. Le Web Libre et sa bidouillabilité ne sont pas que des débats techniques réservés aux techniciens. Cela a avant tout à voir avec le rapport de l'homme à son environnement. Le Web Libre concerne quiconque s'intéresse à l'émancipation et à la liberté.

Oui je suis follement amoureux de ce navigateur et je vous soûle à chanter

ses louanges à longueurs de billets kilométriques, mais franchement il le

mérite. Je pousserai le compliment jusqu'à qualifier la MoFo de FSF du Web

Libre. A vrai dire, il ne manque à la MoFo qu'un ou une évangéliste aussi sexy

que RMS

Réclame : je me suis intéressé à l'aspect plus technique de la bidouillabilité dans plusieurs récents billets, sur l'utilisation de Web Hooks pour bricoler des applications existantes, sur les perspectives ouvertes par le retour d'intérêt pour JavaScript sur le serveur, et dans un questionnement sur le choix d'un langage unique. Ces billets, et peut-être encore un ou deux en gestation, sont des déclinaisons pratiques d'icelui, et offrent peut-être des pistes de réflexion complémentaires.

Ailleurs : je parle beaucoup dans ce billet

d'outils, voire de convivialité. Les outils conviviaux sont un

élément de la pensée d'Ivan

Illich. Certains aspects du présent monologue y font probablement écho.

J'aimerais y revenir à l'occasion, mais vous invite à jeter un œil au concept.

Vous pouvez pas exemple commencer par Ekopedia (reprise de l'article de

Wikipedia sans certaines digressions) et lire

Le web, outil convivial à tendance toxique

d'Eric Mainville, ou le

récent article Vive la

bidouillabilité

d'Adrien Saumier.

Notes

[1] le Web étant un bien public, j'ai décidé de privilégier désormais usager à utilisateur

Le projet européen Indect, en cours depuis le 1er janvier 2009, n'est pas sans rappeler le chef omniprésent évoqué dans le roman 1984 de Georges Orwell. Dévoilé par le journal anglais Telegraph, il a pour but la " détection automatique des menaces, des comportements anormaux ou de la violence ". Les supports surveillés seraient les sites web, les serveurs de fichiers, les forum de discussion, les réseaux P2P ainsi que les ordinateurs individuels. Ajoutée au programme d'Indect : une reconnaissance automatique des comportements suspects dans le réseau de télésurveillance. Une mise en œuvre de cette surveillance déjà crainte par certains et considérée comme menant à la création d'un service de sécurité à l'usage des services secrets européens. Le Telegraph indique que dix pays de l'Union participent au projet qui déjà était alimenté par environ 11 millions d'euros.

- Web 1,2,3Utiliser JavaScript sur le serveur, l'idée est ancienne, mais connaît depuis quelques mois un vif regain d'intérêt. Petit tour d'horizon de cette actualité.

Retour aux sources

On l'oublie souvent, mais au moment de sa conception en 1995 par Brendan Eich pour le compte de Netscape, JavaScript a d'abord été un langage pour le serveur, avant de rapidement intégrer le navigateur. Netscape a longtemps essayé de défendre cette utilisation, avant qu'elle ne disparaisse peu à peu.

Langage maudit du Web 1 (à cause des implémentations incompatibles de Navigator et d'IE qui obligeaient à développer le code en double), JavaScript a peu à peu gagné ses lettres de noblesse avec le Web 2, DHTML et AJAX, et les nombreuses bibliothèques qui ont permis de faire abstraction des spécificités des navigateurs. Depuis environ deux ans, les principaux fondeurs de navigateur se livrent à une compétition forcenée autour de JS, et les performances des moteurs ont explosé (en 10 ans, elles auraient été multipliées par presque 100[1]). Aujourd'hui, il devient par exemple de plus en plus envisageable d'avoir dans le navigateur, propulsées par JavaScript, des applications demandant de la puissance de calcul, comme par exemple de la 3D. Et l'utilisation de JavaScript sur le serveur revient au goût du jour, les performances du langage commençant à rivaliser avec celles des autres. Signes de ce retour, le grand nombre de bibliothèques "serveur" qui fleurissent depuis quelques mois, et surtout le projet CommonJS.

Mais pour quoi faire ?

L'intérêt de permettre à JavaScript d'enfin s'ébattre sur le serveur me semble évident. Utiliser le même langage sur le client et le serveur présente plusieurs avantages:

- actuellement, développer une application Web demande de connaître au moins deux langages, l'un sur le serveur, l'autre dans le navigateur[2] et des langages assez différents, car JavaScript, ne serait-ce que par son implémentation particulière du modèle objet, a une logique bien spécifique. J'ai toujours trouvé fatigant, dans un projet Web, de devoir passer sans arrêt de JavaScript à PHP/Python/Java/Ruby/..., parce que les philosophies sont différentes, et accessoirement certaines petites différence de syntaxe sont propices aux erreurs. Les fréquents sauts d'un langage à l'autre empêchent de se mettre en mode automatique et fatiguent;

- de nombreuses opérations (des validations de données saisies par exemple) doivent être codées deux fois, dans deux langages, avec des implémentations le plus proches possibles. En se limitant à un seul langage, on peut réutiliser davantage de code, avoir la garantie qu'il n'y a pas de différence d'implémentation d'un algorithme entre le client et le serveur (ce qui est toujours la cause de soucis difficilement détectables). On diminue ainsi la charge de travail, et accélère le développement.

- la communication entre le client et le serveur s'en trouve facilitée, puisqu'on est sûr que les données sont encodées et décodées de la même façon;

Plusieurs projets relativement pionniers expérimentent déjà ce type

d'architecture. Par exemple Jaxer, un projet

libre développé depuis plusieurs années par Aptana. Jaxer utilise Gecko sur le

serveur, c'est à dire à la fois le moteur JavaScript, SpiderMonkey, et toutes

les bibliothèques incluses dans Firefox pour manipuler du XML, le DOM, les

accès au système de fichier, etc. Parallèlement Aptana a également créé

ActiveJS, un ensemble de bibliothèques

utilisables aussi bien dans le navigateur que sur le serveur, et facilitant la

mise en œuvre de MVC en JavaScript pur. Parmi les autres précurseurs

, on

pourra également regarder du côté d'Helma

ou de Haxe.

CommonJs

Une des principales raisons pour moi du succès de PHP est la grande richesse de bibliothèques disponibles dans le cœur du projet ou à proximité (c'est à dire dans PEAR ou PECL). Quoi que l'on veuille faire, on trouvera une bibliothèque facile à installer et relativement bien documentée.

JavaScript à l'opposé est un langage que je trouve plus puissant que PHP (il est par exemple réellement objet et offre depuis longtemps des mécanismes qui arrivent timidement dans les dernière versions de l'éléphant bleu), mais pauvre en bibliothèques. Hormis la manipulation du DOM, plus récemment un peu de dessin avec les travaux sur Canvas, on est assez frustré dès que l'on veut l'utiliser pour faire autre chose que que rendre dynamique une page Web. C'est possible, mais encore faut-il trouver les bibliothèques qui vont bien et espérer qu'elles soient compatibles avec le moteur qu'on utilise. Ayant effectué l'essentiel de sa croissance au sein du navigateur, le langage a beaucoup de mal à couper le cordon et s'en émanciper, alors qu'il en aurait le potentiel. C'est pourtant un langage de script moderne qui, du strict point de vue du langage, n'a pas grand chose à envier à PHP, Python, Ruby, etc. Sa faiblesse majeure est dans la pauvreté actuelle de son écosytème, sur le serveur du moins.

Kevin Dangoor, qui travaille sur les outils pour les développeurs chez Mozilla, a remis sur le tapis l'utilisation de JavaScript sur le serveur dans un excellent billet au début de l'année, qui a depuis été suivi de nombreux autres allant dans le même sens. What Server Side JavaScript needs détaille les faiblesses actuelles de JavaScript et l'intérêt d'y remédier pour qu'il prenne enfin son envol sur le serveur. Lancé sous le nom de ServerJS, un groupe de discussion a rapidement eu un gros succès, et a donné naissance au projet CommonJS.

L'objet du projet est de définir un socle d'APIs permettant de répondre aux problématiques les plus courantes, pour que JavaScript dispose enfin des bibliothèques qui lui font tant défaut. La tâche est ardue, car si le cœur de JavaScript est standardisé par l'ECMA, les nombreuses implémentations de la spécification ont parfois pris des libertés avec elle, et surtout ont pallié ses manques en implémentant chacun sa solution. Les problèmes de compatibilité du code sont donc nombreux, et les bibliothèques implémentant CommonJS devront fonctionner de façon transparente avec tous les moteurs disponibles (cf une liste plus bas). Mais elles offriront ainsi un socle sur lequel on pourra s'appuyer pour enfin créer des applications de plus haut niveau, comme jQuery, Prototype et compagnie ont permis de s'abstraire des soucis de compatibilité pour se concentrer sur le développement.

Une version 0.1 de la spécification a déjà vu le jour qui définit l'API de modules inter-opérables, pour pouvoir facilement charger des bibliotèques externes et les faire communiquer entre elles. La version 0.5 en cours de développement crée quatre autres API : pour la manipulation d'objets binaires, l'accès à un système de fichiers, les tests unitaires, et la communication avec les serveurs Web (JavaScript Gateway Interface - JSGI). De nombreuses autres sont en cours de discussion sur le wiki et la liste de discussion. Plusieurs projets ont d'ors et déjà entrepris d'implémenter la spécification, l'un des plus avancés étant sans doute Narwal.

Effervescence

Le regain d'intérêt pour l'utilisation de JavaScript sur le serveur est aussi manifeste par le nombre de projets qui ont éclos ces derniers mois. La liste est longue, en voici quelques uns parmi ceux que je trouve les plus prometteurs:

- Narwhal est un ensemble de bibliothèques JS conformes à CommonJS. Le projet aspire à être indépendant du moteur. Narwhal sert entre autre de base à Jack, une couche permettant la communication entre des applications JavaScript s'exécutant sur un serveur, et un serveur Web. Jack implémente la spécification JSGI, développée pour l'occasion, qui définie une API pour ces communications. JSGI s'inspire des spécification WSGI en Python et Rack en Ruby;

- Persevere est un serveur permettant entre autre de stocker des objets JavaScript et d'y accéder directement via des services REST. Il est développé par l'équipe de Dojo et en particulier par Kris Zyp dont j'ai déjà parlé dans mes billets sur JSON. Grâce à CommonJS, Narwhal et Persevere peuvent à présent être utilisés de concert, au travers de l'API de modules;

- Helma NG (Next Generation) est un framework JavaScript serveur écrit en Java et basé sur Rhino. Sa nouvelle version (NG) vise à le simplifier et à implémenter CommonJS;

- Node est un serveur écrit en JavaScript et utilisant le moteur V8. Il propose une implémentation de serveur alternative à celle habituelle basée sur des threads. Il s'inspire par exemple de Twisted en Python. S'il n'implémente pas encore CommonJS, c'est un bel exemple de l'intérêt d'utiliser JS sur le serveur;

Mis à jour j'oubliais que JavaScript est aussi le langage invité de nouvelles bases de données comme CouchDB, où il est utilisé pour faire des requêtes complexes. Il commence donc même à se faire sa place dans le domaine des bases de données.

Quoi d'autre ?

Dernier point, j'ai parlé jusqu'à présent d'unification du langage utilisé

dans le client et sur le serveur, mais il y a un troisième acteur à prendre en

compte: la plate-forme, en l'occurrence le navigateur. Personne n'ignore que

JavaScript est utilisé intensivement dans Firefox, et tout particulièrement

dans les extensions. Une position qui va encore gagner en importance avec

l'arrivée de JetPack, la nouvelle architecture pour les extensions, dont le

slogan est si tu sais créer une appli Web, tu sais aussi créer une

extension

. Pour ce que j'en ai vu, les extensions Chrome vont elles aussi

utiliser JS. CommonJS a donc également une indéniable utilité à ce niveau, en

permettant de créer des composants génériques qui seront également utilisables

par la plate-forme, le navigateur, et portables d'un navigateur à l'autre. A

terme, cela facilitera sans doute encore les interactions entre le navigateur

et les contenus.

Ces nouveaux horizons qui s'ouvrent à JavaScript me plaisent beaucoup. Vu la vitesse à laquelle les différents projets avancent, on devrait voir des trucs assez sympas arriver dans les prochains mois.

Annexe : tour d'horizon des moteurs

A ce jour, les moteurs libres les plus répandus et qui peuvent être utilisés sur le serveur, sont

- SpiderMonkey : inventé par Brendan Eich en même temps que JavaScript, il est aujourd'hui maintenu par Mozilla. Il évolue aujourd'hui sous le nom de TraceMonkey en intégrant des bouts de Tamarin, un projet commun à Mozilla et Adobe. SpiderMonkey étant codé en C, il offre des mécanismes pour utiliser des routines écrites en C ou C++. C'est ainsi que dans Firefox, composants en C++ et modules en JavaScript travaillent de concert;

- Rhino est un moteur en Java développé par Mozilla. Il offre aussi des passerelles avec Java. On peut ainsi appeler des bibliothèques Java depuis le code JavaScript, ou utiliser Rhino dans un projet Java ayant besoin de fonctions de scripting;

- v8 de Google, probablement le plus véloce actuellement;

- SquirrelFish utilisé dans Safari. mise à jour on me glisse en commentaire que 4D, éditeur d'une fameuse base de données sur Mac, travaille sur le projet Wakanda qui l'utilisera;

- je ne parle pas des moteurs utilisés dans Opéra ni IE car je ne sais pas s'ils existent en tant que projets indépendants du navigateur. Ils ne sont de toute façon à ma connaissance pas libres;

- pour aller plus loin, Wikipédia propose une liste plus complète de moteurs;

Notes

[1] référence nécessaire, j'ai vu ça dans une graphique sur un site de développeur Google, mais sans source et je ne le retrouve même plus. Si vous avez des infos...

[2] je n'ai pas encore testé les solutions qui génèrent automatiquement le code client depuis le langage serveur, comme Google Web Toolkit par exemple, j'avoue qu'elles m'attirent moins

On dit parfois en parlant des avancées technologiques que la réalité rattrape la fiction, ce n'est pas cette actualité qui dérogera à la règle. En 1998, le film Bienvenue à Gattaca présentait une...

Mon quotidien professionnel me donne l'opportunité de voir les usages et les habitudes des utilisateur chevronnés. Les power users comme on les appelle bien souvent. Ceux qui vont ouvrir la danse, être les premiers sur à s'échanger des touites, avoir les premiers comptes sur les livres de fesse ou même ceux qui administrent leur serveur perso.

Et je remarque avec horreur l'usage moyen de l'internaute power user lamba : il stocke ses mails sur gmail, il a un compte sur les réseaux sociaux à la mode, il n'hésite pas à prendre son iPhone pour envoyer des messages et organiser sa vie numérique. Sites communautaires uniques, centralisation des communications, voilà les usages que l'on constate aujourd'hui. Surement dans l'ère du temps. Pas de diversité, un site unique pour chaque besoin.

Une aubaine pour les opérateurs. La diversité des connexions et des consultations du ternet actuel entraine des coûts importants : il fallait que les tuyaux arrosent les jardins alentours. Maintenant, on demande un gros tuyau, tout le monde emprunte le même. Le tout-à-l'égout de l'information en somme.

Ces nouvelles habitudes vont donc dans le futur modifier nos abonnements. Pourquoi fournir un service vers une infinité de sites quand l'utilisateur n'en consulte que quelques-uns ? C'est tout la logique actuelle de l'internet mobile : en achetant un téléphone comme l'iPhone, vous avez un accès illimité à certains sites. On paye un prix, on a accès à un service qui répond à un usage unique.

Pratique pour l'opérateur, tout est centralisé, plus maîtrisable, analysable et moint coûteux. Utilisateurs de services différents ? Passez votre chemin ou sortez les brouzoufs du porte-monnaie. En revanche, pour le consommateur lamba, se levant à 6H du matin et lisant ses gmails (le terme email sera probablement remplacé dans un futur proche) sur son iPhone, c'est tout bonheur : il paiera peu et aura une bande passante conséquente pour voir la bande annonce du prochain film de TF1 qu'il verra avec bobonne dans le lit (par contre, pour la bande annonce du film de porn sur canal plus le samedi soir, l'iPhone devra procéder à quelques vérifications physique afin d'assurer que l'utilisateur est bien majeur).

Mais à l'avenir, comme le dit la pub de notre ancien opérateur national, il y aura Internet et internet.

Cela est-il un signe d'un réseau où une entreprise unique s'associera avec le fournisseur de bande passante pour être en situation de monopole ? Où tout sera centralisé ? Où le bouton "Mail" de mon prochain terminal d'accès initiera finalement des connexions vers gmail, où un autre bouton "contacter mes amis" démarrera MSN ? Est-ce cela l'internet comme nous l'avions pensé ? Quid de la concurrence, de l'indépendance, de la sécurité. Bref, de la liberté.

Il y a là des usages repenser. Une question éthique à aborder. Que les utilisateurs comprennent enfin que l'avenir de ce réseau ne dépend que d'eux. Internet tel qu'il a été pensé est totalement décentralisé, ne pouvant être mis sous contrôle aussi facilement. L'internet mobile changera-t-il la donne ? L'uniformisation, la centralisation ont toujours été dangeureux sur tous les aspects (sécurité - quid de vos données, de vos mails, sûreté - qui vous assure que le service sera toujours rendu, respect de la vie privée - qui a réellement accès à vos données, etc ...). Ces thèmes auront-ils encore du sens dans les années à venir ?

Article traduit en espagnol : El objetivo es fichar el ADN de toda la población

La première étape est de mettre en place l’infrastructure, et d’engager les techniciens de laboratoire. Ce qui devait nous prendre environ un an.

Le but est de ficher, à terme, la totalité de la population.

Notre objectif est d’échantillonner un million de gens par an, ce qui devrait nous prendre 10 ans si l’on prend en compte l’évolution de la population.

Le Dr Ahmed al Marzooqi est le responsable de la base de données ADN nationale au ministère de l’Intérieur des Emirats Arabes Unis.

Le Dr Ahmed al Marzooqi est le responsable de la base de données ADN nationale au ministère de l’Intérieur des Emirats Arabes Unis.

C’est le premier pays à avoir décidé de ficher les empreintes génétiques de l’intégralité de sa population, expatriés, immigrés et “visiteurs” compris, indéfiniment -ou au moins jusqu’à leur mort.

Les tout premiers à être fichés seront les mineurs, au motif que “la majeure partie des criminels commencent lorsqu’ils sont jeunes. Si nous les identifions à cet âge, il sera plus simple de les réhabiliter avant qu’ils ne commettent de crimes encore plus graves“.

“Dans les années 80, la nanotechnologie offrait du rêve à tous ceux qui se sentaient soucieux de l’avenir de la planète. Il devenait évident qu’il faudrait un jour réduire la quantité de matière et d’énergie consommée pour fabriquer toutes nos machines.

La nanotechnologie, alors balbutiante, allait, espérions-nous, libérer l’industrie de l’utilisation massive de matériaux pour la faire entrer dans une ère de développement durable”.

L’an passé, Christian Joachim, pionnier de la manipulation à l’échelle atomique, rappelait dans un livre intitulé “Nanosciences : la révolution invisible” (extrait) comment “les” nanotechnologies ont détourné “la” nanotechnologie de son projet durable.

L’an passé, Christian Joachim, pionnier de la manipulation à l’échelle atomique, rappelait dans un livre intitulé “Nanosciences : la révolution invisible” (extrait) comment “les” nanotechnologies ont détourné “la” nanotechnologie de son projet durable.

Car depuis les années 80, les industriels se sont emparés du sujet, et plutôt que d’attendre une hypothétique viabilité de “la” nanotechnologie, ils ont misé sur “les” nanotechnologies qui, rappelait Joachim, “ne concernent plus seulement la manipulation de la matière atome par atome, mais qui font référence à toutes ces techniques permettant de fabriquer de “petits objets”” :

“Aujourd’hui, les nanotechnologies ne sont pas associées à l’espoir d’une industrie plus économe des ressources de la planète, mais au contraire à des craintes : ne sont-elles pas toxiques ? Ne risquent-elles pas de nous échapper ?”

Alors qu’on répertorie d’ores et déjà plus de 1000 produits de grande consommation en vente dans le commerce incluant des nanomatériaux (cf Nanotechnologies : ce qui se vend), le Bureau européen de l’environnement (EEB, qui se présente comme “la voix environnementale des Européens“, et qui fédère plus de 140 ONG dans 31 pays), et le Réseau international pour l’élimination des Polluants organiques persistants (IPEN, qui réunit plus de 700 ONG, dans plus de 80 pays), ont voulu faire le point sur la question :

“Les nanotechnologies nous sont présentées comme susceptibles d’offrir des solutions technologiques inédites à nombre des problèmes environnementaux tels que le réchauffement climatique, la pollution et l’accès à l’eau potable.

Ses partisans affirment qu’elles peuvent contribuer au développement économique et susciter de nouveaux produits et marchés tout en réduisant de façon notable notre empreinte écologique”.

Dans leur rapport intitulé “Nanotechnologie et environnement : un décalage entre les discours et la réalité (.pdf), les deux fédérations d’ONG environnementales estiment, a contrario et sur la base de plusieurs dizaines d’études et rapports académiques et scientifiques, que cette vision quasi angélique masque “de sérieux risques environnementaux, ainsi que des coûts cachés qu’on aurait tort d’ignorer” :

La “face cachée” du coût environnemental de la production de nanomatériaux (tels qu’une demande accrue en énergie et en eau) est rarement reconnue, alors que leurs “bénéfices” affichés sont souvent exagérés, non testés et, dans un grand nombre de cas, à des années de pouvoir être concrétisés.

Une production plus propre… ou plus sale ?

Chimie “verte“, réduction de la consommation de ressources naturelles et de matières premières… pour leurs promoteurs, les nanotechnologies peuvent contribuer à la réduction de l’empreinte écologique des processus industriels.

Or, estiment les auteurs du rapport, la fabrication de nanomatériaux requiert énormément d’eau et d’énergie, produit (paradoxalement) beaucoup de déchets, pour des rendements somme toute plutôt faibles.

De plus, les produits chimiques utilisés, ainsi que les nanomatériaux eux-mêmes, sont souvent “hautement toxiques“, générateurs de gaz à effet de serre contribuant au réchauffement climatique et à l’épuisement de la couche d’ozone.

Enfin, et en l’état des connaissances, il serait illusoire de croire que l’on pourrait mettre en place une gestion durable du cycle de vie des nanotechnologies d’ici, au mieux, une quinzaine d’années.

Surveillance et assainissement de l’environnement, filtration des eaux polluées ou potables, réduction de la pollution agricole… les nanotechnologies sont pourtant présentées comme susceptibles de contribuer au respect, et à la préservation, de l’environnement.

Or, le rapport souligne également qu’on ne dispose pas, à ce jour, du profil écotoxicologique des nanomatériaux d’ores et déjà disponibles sur le marché. S’en servir pour filtrer l’eau, ou comme pesticides, serait donc non seulement hasardeux, mais risquerait également d’accroître la dépendance des paysans et habitants des pays pauvres envers des entreprises privées occidentales, au détriment d’autres méthodes, locales et moins coûteuses.

Dans un rapport (.pdf) consacré à la nanotoxicologie, le projet européen NanoSafe2, chargé de “développer une stratégie de risque et de management pour une production industrielle sécurisée de nanoparticules” relève ainsi que :

Dans un rapport (.pdf) consacré à la nanotoxicologie, le projet européen NanoSafe2, chargé de “développer une stratégie de risque et de management pour une production industrielle sécurisée de nanoparticules” relève ainsi que :

“L’étude des effets toxiques des nanomatériaux est encore en cours et de nombreuses questions n’ont toujours pas de réponses.

Le nombre de nanoproduits évolue très rapidement. Il est dès lors urgent d’examiner, pour chacun d’entre eux, les risques d’exposition et leur toxicité potentielle.

De nouvelles méthodes de toxicité doivent être développées et validées. L’impact potentiel sur la santé humaine et l’environnement devrait être testé sur l’ensemble du cycle de vie des matériaux.”

Un nouveau scandale de l’amiante ?

Le problème est aussi sanitaire : plusieurs études ont ainsi démontré, soulignent l’IPEN et l’EEB, que des nanomatériaux d’ores et déjà disponibles dans le commerce pouvaient endommager l’ADN humain, entraîner la mort de certaines cellules, s’avérer toxiques pour certaines espèces végétales et animales, nuire à la reproduction des vers de terre (dont le rôle, dans l’écosystème, est fondamental).

Les nanotubes de carbone, utilisés afin d’augmenter l’efficacité des batteries au lithium, et d’alléger voitures et avions, sont censés permettre d’effectuer de notables réductions de la consommation d’énergie, mais il est impossible de savoir si leur production entraînera plus, ou moins, de consommation énergétique que leur utilisation ne permettra d’en économiser…

Pour en revenir à la santé, plusieurs études ont démontré que certains nanotubes de carbone causaient des inflammations et fibroses pouvant entraîner attaques cardiaques et dommages génétiques, ainsi que le mésothéliome, forme rare et virulente de cancer connue jusque-là comme résultant de l’exposition à l’amiante.

En août dernier, une étude publiée dans l’European Respiratory Journal faisait, pour la première fois, le lien entre l’exposition à des nanoparticules et le développement de maladies chez l’homme : sept travailleuses chinoises, admises à l’hôpital, avaient été exposées, plusieurs mois durant et sans se protéger suffisamment, à des nanoparticules dans leur atelier de peinture. Elles souffraient d’éruptions cutanées, et d’affections du poumon, du fait de la présence, dans leurs organismes, de nanoparticules nuisant au bon fonctionnement de leurs coeurs et de leurs poumons. Deux en sont mortes.

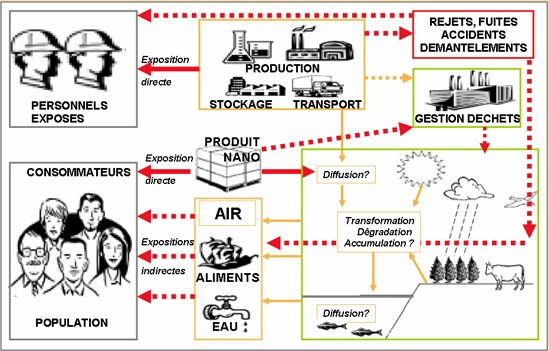

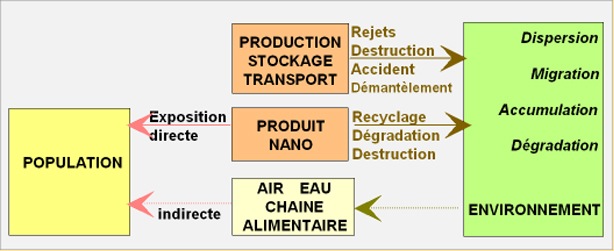

Dans un autre rapport (.pdf) consacré à l’impact sanitaire et environnemental des nanomatériaux, l’EEB pointe également du doigt l’absence d’information sur les volumes de production, la nature des procédés et des nanomatériaux utilisés (sous couvert, notamment, du secret industriel), les risques accrus d’exposition pour les êtres humains, et de dispersion dans l’environnement, d’autant que l’on ne connaît pas les risques potentiels que font peser, à moyen et long terme, chacun de ces nanomatériaux.

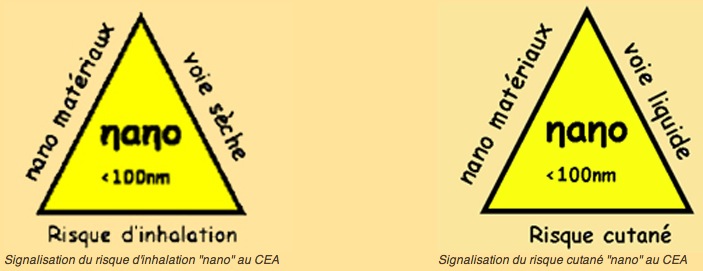

Du fait de leur nature chimique, mais aussi de leurs propriétés physiques (dimension, surface, forme et structure), les nanoparticules se comportent de façons très différentes, et peuvent, par inhalation, ingestion ou absorption au travers de la peau ou des organes internes, traverser des barrières qui, d’ordinaire, protègent nos organes de toute intrusion extérieure. Ainsi, certains nanomatériaux seraient susceptibles de traverser la barrière placentaire, et aller aller au contact de bébés avant même qu’ils ne soient nés, affirment les rapporteurs.

Non seulement les scientifiques, et ceux qui s’intéressent aux nanotechnologies, sont encore bien souvent à court de réponses, mais les perspectives offertes doivent aussi les inciter à se poser de nouvelles questions.

Dans leur réponse (.pdf) à la consultation publique européenne sur le volet scientifique de la nanotechnologie, l’EEB et la branche allemande des Amis de la Terre estiment ainsi qu’il convient aussi de débattre des enjeux sanitaires, éthiques et législatifs des prochaines générations de nanomatériaux, des médicaments “intelligents” ciblant telles ou telles types de cellule jusqu’aux espoirs transhumanistes de biologie synthétique ou d’augmentation du corps humain.

Sans attendre jusque-là, la commission royale britannique sur la pollution environnementale notait de son côté l’an passé que de nombreuses nanoparticules s’agglomèrent dans la nature, formant de bien plus larges structures dont les propriétés toxicologiques pourraient être différentes de celles des nanomatériaux d’origine.

De même, notent l’EEB, on ne dispose pas de données sur les effets qu’engendreront les “cocktails” de nanomatériaux auxquels nous serons confrontés, tant à l’extérieur pour ceux qui auront été relâchés dans la nature, qu’à l’intérieur pour ceux que nous aurons ingérés, inhalés ou qui auront traversé l’épiderme.

Une nouvelle révolution industrielle

La fin de vie des nanomatériaux est elle aussi sujette à caution, et l’on ne sait pas vraiment en quelle mesure ils peuvent être recyclés. Or, 95% des nanoparticules utilisées en cosmétique, dans les peintures et enduits, pourrait se retrouver dans les eaux usées, et même enfouis ou incinérés, les nanotubes de carbone -dont la production, en 2007-2008, est estimée à 350 tonnes- sont susceptibles de rester intacts, et de se disperser dans l’air ou l’environnement.

Dans un précédent rapport (.pdf), consacré cette fois aux “nanotechnologies vertes“, l’EEB revenait également sur cette “nouvelle révolution industrielle” en rappelant que, de leur temps, l’amiante et le DDT avaient eux aussi été parés de toutes les vertus, avant de causer les dégâts que l’on connaît.

Prenant l’exemple des nanotechnologies environnementales dont le marché, à l’horizon 2010, est estimé à 6,1 milliards de dollars, et qui sont censées aider à la décontamination environnementale, et à l’amélioration de la gestion des déchets, l’EEB s’interroge :

“Comment être sûr que la technologie utilisée est non seulement efficace mais aussi moins toxique que les polluants qu’elle est censée nettoyer ? Les nanoparticules utilisées pour filtrer les polluants finiront-elles dans la chaîne alimentaire, à dégrader les sols, entraîner des maladies végétales, et contaminer les terres agricoles ?”

L’EEB n’en reconnaît pas moins que les nanotechnologies joueront, par exemple, un rôle important dans la “production“, la désalinisation et la purification de l’eau, “qui sont devenues une véritable industrie“. Ainsi, le département de Dow Chemical qui en a la charge est celui dont le chiffre d’affaires (500 M$) a le plus rapidement progressé en 2006.

Mais l’EEB et l’Ipen y voient aussi une fuite en avant technologique qui, plutôt que d’apporter des solutions aux problèmes urgents de l’humanité, constituerait surtout une “nouvelle vague” d’expansion industrielle, avec son corrélat d’exploitation des ressources énergétiques et d’exacerbation des destructions environnementales.

La question n’est pas technologique, mais politique

En 2006, le Project on Emerging Nanotechnologies (PEN), une fondation américaine qui veut oeuvrer à plus de transparence en matière de nanotechnologies, avait estimé que plus de 58 000 tonnes de nanomatériaux seraient produites entre 2011 et 2020, et que leur impact écologique pourrait être équivalent à celui posé par entre 5 millions et 50 milliards de tonnes de matériaux conventionnels…

Cette valse de chiffres témoigne bien du faible niveau de connaissances et de données disponibles à ce jour sur ce que deviendront les nanomatériaux et les façons qu’ils auront de se disséminer dans la nature et notre environnement. D’autant que, du fait de l’absence de règlementation, les industriels ne sont pas tenus d’informer les consommateurs de la présence de nanomatériaux dans leurs produits.

En février dernier, l’EEB rendait publiques ses “exigences en vue d’une gouvernance durable pour les nanomatériaux (.pdf)” :

“L’exigence essentielle de l’EEB, c’est qu’aucune nouvelle mise sur le marché ne soit autorisée pour les produits contenant des nanomatériaux manufacturés susceptibles de conduire à l’exposition des consommateurs ou de l’environnement. (…)

Les produits de ce type déjà sur le marché devraient être réglementés au titre de l’approche REACH fondée sur le principe “pas de données, pas de marché” et devraient donc être retirés de la circulation commerciale.”

La fédération d’ONG environnementales appelait également la Commission européenne à exiger l’évaluation et l’approbation des utilisations des nanomatériaux avant leur mise sur le marché, tout en notant que “l’expérience relative à la législation REACH (la règlementation la plus complète de l’UE sur les produits chimiques) a déjà mis en évidence les limitations de cette législation en ce qui concerne les nanomatériaux et montré que les outils de mise en œuvre actuels (par exemple les méthodes de test, la nécessité de communiquer les résultats des tests, etc.) ne s’appliquent pas au niveau nano“.

Dès lors, l’EEB appelle à la révision de la législation existante, à l’élaboration d’une règlementation spécifique au secteur nano, à l’application du principe de précaution et du principe “pollueur payeur“, et à l’établissement d’”un label obligatoire UE qui serait un outil d’identification des produits contenant des nanomatériaux manufacturés susceptibles de conduire à l’exposition des consommateurs ou de l’environnement“.

Notant qu’”à l’heure actuelle, la grande majorité des fonds de recherche en nanotechnologies dans l’UE porte essentiellement sur le développement technologique, axé sur l’amélioration de la compétitivité et de la croissance“, l’EEB appelle la Commission à donner la priorité au financement des recherches sur les impacts éventuels sur les systèmes humains et naturels.

La conclusion de son étude conjointe avec l’IPEN soulignait bien le manque de vision politique et sociale du débat autour des nanotechnologies tel qu’il s’est pour l’instant déroulé : “la nanotechnologie est la dernière innovation technologique nous promettant de guérir de nombreux maux humains et environnementaux. En se focalisant sur la nanotechnologie isolément, le risque est grand de ne s’intéresser qu’aux seuls impacts technologiques” :

“La nanotechnologie, comme la biotechnologie, va bien au-delà de notre connaissance des systèmes et cycles naturels, et de notre capacité à surveiller et contrôler ses effets négatifs non désirés.

Sans analyse des risques et cycles de vie susceptibles de contre-balancer la commercialisation de produits à haut risque n’ayant pas encore démontrer leur intérêt social, les coûts environnementaux pourraient s’avérer très élevés, et la technologie dans son ensemble être rejetée par le grand public.

Cela ne peut qu’entraîner des troubles sociaux dans la mesure où le public n’est pas capable de participer au processus de décision social, faute de pouvoir comprendre les tenants et aboutissants de la discussion, et leur confiance dans les pouvoirs publics et les entreprises privées ne peut qu’en être érodée.

Les nanotechnologies sont un exemple de réponse technologique à des problèmes qui requièrent, en réalité, des réponses sociales, économiques et/ou politiques.”

NB: les iconographies sont des copies d’écran du site NanoSmile, consacré à la sécurité des nanomatériaux et réalisé par le Commissariat à l’Energie Atomique (CEA) dans le cadre du projet europen NanoSafe.

biotechnologies, Nanotechnologie, NBIC, prospective, sécuritéEt si la planète était encore plus menacée qu’on ne le pense ? Et si les mesures actuelles envisagées contre le réchauffement climatique (réduction des émissions, taxe carbone, green design…), n’étaient qu’emplâtres sur une jambe de bois ? Le fait est qu’il y a souvent une distance entre le discours volontiers alarmiste (et probablement avec raison) des penseurs écologistes et la relative modération des solutions proposées.

Face à l’urgence de résoudre le problème climatique, une solution “taboue” commence à avoir de nouveau droit de cité : la géo-ingénierie.

Pour résoudre la crise écologique, modifions plus encore le système écologique !

Qu’envisagent donc les adeptes de cette discipline? La modification voulue et systématique du système écologique terrestre, tout simplement. On comprend que cela fasse grincer des dents ! Car une erreur sur une entreprise de cette ampleur pourrait bien nous être fatale à tous. Imaginez les débats et les peurs liées aux OGM, au nucléaire, à la nanotechnologie, à la modification du vivant… mélangez-les et multipliez par 10 : vous aurez peut-être une légère approximation de l’inquiétude que suscite le débat qui s’amorce autour de la géo-ingénierie.

Dernier “converti” en date, non sans une certaine réticence : Jamais Cascio, un futurologue convaincu par la cause écologiste souvent évoqué dans nos colonnes, connu pour sa participation à des projets comme Worldchanging et auteur d’une collection d’essais sur le sujet baptisée Hacking the Earth.

Image : La terre vue par la mission Apollo 17.

Dans un récent article pour le Wall Street Journal, il explique :

“Si nous voulons éviter un désastre climatique, il va falloir que nous adoptions une action plus directe. Nous devons commencer à penser à refroidir la planète.

Ce concept est appelé géo-ingénierie et au cours des années précédentes, il est passé du statut d’idée marginale à celui de sujet de débats intenses dans les coulisses du pouvoir. Nombreux sont ceux qui, parmi nous, ont suivi ce sujet de très près et sont passés du statut de sceptiques à celui de partisans. Des partisans méfiants, mais des partisans tout de même. (…)

Soyons clairs : la géo-ingénierie ne résoudra pas le réchauffement global. Ce n’est pas une “solution technique”. Elle pourrait s’avérer très risquée et amènerait certainement de nombreuses conséquences imprévues et problématiques. (…) Mais la géo-ingénierie pourrait aussi ralentir la montée des températures, repousser l’avènement de points de non-retour comme la fonte catastrophique des glaces du pôle et nous donner du temps pour laisser à nos économies et nos sociétés le temps d’effectuer les transformations nécessaires pour mettre fin au désastre climatique.”

Cascio n’est pas le seul à se ranger aujourd’hui du côté des “géo-ingénieurs”. D’autres, comme James Lovelock, créateur de la fameuse hypothèse Gaia et célèbre pour ses prédictions terrifiantes sur le futur du climat (si la température augmente de 5° au cours du prochain siècle, prédit-il notamment, 90% de la population humaine mourra par manque de nourriture et d’eau) vont dans le même sens : “Je suis totalement d’accord avec l’idée que nous avons besoin d’un “plan B” dans lequel une stratégie de géo-ingénierie est mise en place parallèlement aux moyens de réduire le CO²”, explique Lovelock à The Independant. “Le changement climatique est un problème du système terrestre tout entier et je pense que l’ONU n’est pas une institution capable de l’organiser et le gérer.”

Le sujet est devenu encore plus sérieux en ce mois de septembre lorsque la Royal Society a sorti un rapport sur les techniques de géo-ingénierie. Un document au contenu très complet et qui présente les avantages et inconvénients de manière “objective”, ce qui risque de le rendre plutôt impopulaire : “C’est un excellent rapport, écrit Richard Jones, professeur de physique à l’université de Sheffied, sur son blog, “mais en jugeant la façon dont il a été reçu dans les médias, il court le danger de ne plaire à personne. Les environnementalistes qui considèrent toute discussion sur la géo-ingénierie comme un blasphème seront consternés de voir le concept gagner en popularité. (…) Les techno-optimistes, au contraire, s’agaceront des réserves très sérieuses qu’émet le rapport.

Le plus fort argument du rapport en faveur de la géo-ingénierie consiste à affirmer que nous pouvons le concevoir comme un plan B, une police d’assurance au cas où de véritables réductions du CO² s’avéreraient impossibles.”

Le plan B pour sauver la terre

Plan B : c’est le terme fréquemment utilisé pour designer la géo-ingénierie. (c’est d’ailleurs le titre d’un article de Slate paru récemment en français sur le sujet).

Curieusement, la géo-ingénierie semble attirer les deux camps opposés sur l’échiquier écologique. Si des Cascio ou des Lovelock insistent sur l’urgence de la situation et la nécessité de tout faire pour arranger les choses aux prix de gros risques, d’autres comme Bjorn Lomborg y voient plutôt une raison de ne pas trop s’en faire. Bjorn Lomborg est le très contesté auteur de “L’écologiste sceptique”, préfacé par Claude Allègre dans version française.

Image : Le soleil - et non pas la terre - et ses irruptions prise par la mission Trace via Pruned.

Comme il l’explique dans un article pour la revue économique Forbes, “le coût estimé des actions permettant d’éviter une montée de deux degrés d’ici 2100 serait de 12,9% du Produit national brut mondial, soit 40 mille milliards de dollars par an. En comparaison, gérer la montée globale de la température coûterait 3 mille milliards par an en 2100, ce qui est bien inférieur.”

L’enthousiasme de Lomborg pour la géo-ingénierie tient au fait qu’il voit là un moyen d’éviter le coût et les efforts énormes nécessités par les stratégies actuellement envisagées pour réduire les émissions de CO² (seulement 9 mille milliards de dollars, selon lui, pour mettre en oeuvre la technologie des “gouttelettes”, sur laquelle nous reviendrons). C’est un point de vue très libéral qui, on l’a deviné, n’est pas du tout celui d’un Cascio, d’un Lovelock ou celui des auteurs du rapport de la Royal Society.

Quand des gens qui se situent idéologiquement à 180° les uns des autres commencent à envisager la même solution, faut-il croire que son temps est venu ?

The Independent a interviewé, dans la foulée de la publication du rapport de la Royal Society, un groupe de scientifiques britanniques et américains. Les avis sont souvent divergents, mais l’impression générale est celle d’une attitude mesurée mais souvent bienveillante envers la géo-ingénierie.

Agir ou ne pas agir : les risques

Selon Martin Parry du Collège Imperial de Londres : “il est maintenant trop tard pour tergiverser. Il faut développer une stratégie en trois points :

- 1) réduire les émissions le plus vite possible ;

- 2) s’adapter à une vie avec 3 degrés supplémentaires ;

- 3) utiliser la géo-ingénierie pour faciliter la transition entre la période de réduction et celle d’adaptation.”

D’après Petr Chylek du laboratoire de Los Alamos : “La géo-ingénierie devrait se consacrer à un but unique : éviter la fonte des glaces du Groenland. Cela diviserait les coûts d’une telle entreprise par un facteur situé entre 10 et 100″.

Pour Kerry Emmanuel du Massachusetts Institute of Technology (MIT): “La solution de la géo-ingénierie est peut-être moins que désirable, mais la probabilité d’obtenir un accord global pour la réduction des émissions de CO² est aujourd’hui très faible.”

John Matham du Centre national américain sur la recherche atmosphérique y croit fort : “Il est vital d’utiliser la géo-ingénierie pendant qu’on effectue des recherches sur des formes d’énergie propres”. La technologie des “gouttelettes d’eau” (voir prochain article) étudiée par son groupe pourrait, selon lui, maintenir constante la température pendant 50 ans et permettre de sauvegarder la couverture arctique durant cette période.

D’autres sont plus dubitatifs.

Chris Rapley,directeur du Musée des sciences de Londres, n’est pas enthousiaste de la géo-ingénierie qui pourrait avoir des conséquences inattendues. Il soutient (avec Lovelock d’ailleurs) l’idée “d’aider la terre à s’aider elle-même en utilisant les procédés de séquestration du carbone déjà employés naturellement, comme par exemple par la protection des forêts tropicales”. Mais, pour lui, “nous avons peut-être déjà atteint le point de non-retour.”

Pour Corinne le Quere de l’université d’East Anglia, pas la peine au contraire d’espérer gagner du temps par ce biais. “La géo-ingénierie pourrait stabiliser le climat sur le long terme, mais elle serait inefficace vu le peu de temps qu’il nous reste.”

Anthony Patt, de l’Institut international pour l’analyse des systèmes, rappelle que la géo-ingénierie ne pourrait résoudre qu’une partie du problème (par exemple la fonte des glaces) mais en laisserait d’autres intacts, comme l’acidification des océans, ou la réduction du cycle de température diurne et annuelle.

Luanne Thompson, de l’Ecole d’océanographie de l’université de Washington, est encore plus inquiète : l’adoption de la géo-ingénierie anéantirait les derniers espaces de pêche sauvages, et pourrait de plus détruire l’écosystème océanique, qui absorbe une partie du CO². Du coup, l’opération pourrait produire plus de CO² qu’elle ne cherche à en préserver ! Et de conclure “la géo-ingénierie n’est tout simplement pas acceptable. Le coût (écologique) en est trop élevé”.

Mais quelles sont donc les techniques qui pourraient être utilisées pour refroidir la planète ? Quels sont les coûts, les avantages, les risques ? C’est ce que nous allons voir dans la seconde partie de ce dossier, en prenant pour point de départ les conclusions du rapport de la Royal Society. Ensuite, il faudra se pencher sur les implications politiques, économiques et éthiques de la géo-ingénierie, et à côté de ces difficultés-là, refroidir la Terre pourrait bien n’être qu’une partie de plaisir…

Rémi Sussan

Le dossier, Géo-ingénierie, l’ultime recours ?

- Première partie : Un tabou s’effondre

- Seconde partie : Que propose-t-on de faire ?

- Troisième partie : Ultimes précautions ?

buzzz marketing (s'abonner) : Une étude américaine démontre que les moustachus ont une meilleure carrière que les autres. ...

Pur Délire (s'abonner) : Le Port de la moustache dans une carrière ...

participants : marketing insolite, buzzz marketing, Pur Délire, ...

(6 posts, dernière mise à jour 13/10/2009 21:52)