Liste de partage de Grorico

Liste de partage de Grorico

Un réseau “suffisamment bon”, mais jusqu’à quand ?

L’informaticien John Day, coconcepteur d’Arpanet, dans son livre Patterns in Network Architecture : A Return to Fundamentals (que l’on pourrait traduire par Modèles d’architecture de reseau : un retour aux fondamentaux) explique que le problème avec Arpanet, l’ancêtre de l’internet, “était que nous avons eu raison sur trop de points dès le départ”. Les idées émises étaient tellement inspirées que cela a permis de réaliser un réseau “suffisamment bon” (c’est-à-dire, finalement suffisamment solide pour résister à sa croissance jusqu’à présent et suffisamment ouvert pour accueillir une grande variété d’innovation). Cependant, ces concepteurs ont oublié de traiter certaines questions fondamentales.

L’informaticien John Day, coconcepteur d’Arpanet, dans son livre Patterns in Network Architecture : A Return to Fundamentals (que l’on pourrait traduire par Modèles d’architecture de reseau : un retour aux fondamentaux) explique que le problème avec Arpanet, l’ancêtre de l’internet, “était que nous avons eu raison sur trop de points dès le départ”. Les idées émises étaient tellement inspirées que cela a permis de réaliser un réseau “suffisamment bon” (c’est-à-dire, finalement suffisamment solide pour résister à sa croissance jusqu’à présent et suffisamment ouvert pour accueillir une grande variété d’innovation). Cependant, ces concepteurs ont oublié de traiter certaines questions fondamentales.

Le réseau s’est étendu mais grâce à l’augmentation régulière de la puissance de calcul et de la bande passante, et malgré l’explosion du nombre d’utilisateurs et la grande diversification des applications, le réseau est resté “suffisamment bon”… jusque récemment.

Les limites actuelles de l’internet

Car les choses sont en train de changer. Avec plus d’un milliard d’humains et autant d’objets connectés, les 4 milliards d’adresses disponibles deviennent dramatiquement insuffisantes (elles sont réparties très inégalement avec plus d’adresses pour l’université de Harvard que pour l’ensemble de la Chine. La pénurie devrait advenir entre 2010 et 2012 estiment les spécialistes…).

Par ailleurs, malgré l’augmentation constante de la bande passante, un problème de puissance se pose au niveau du routage : comment retrouver très rapidement des adresses dans des tables de routage immense avec des routeurs qui arrivent à la limite de leur capacité de calcul ?

Enfin, il faut faire cohabiter des besoins très différents sur le réseau : ceux des simples humains que nous sommes (le multimédia, la mobilité, l’adaptabilité à de nouvelles innovations), ceux des objets (qui supportent mal les protocoles très verbeux qui consomment beaucoup d’énergie alors qu’ils devraient être autonomes pour toute la durée de leur vie, le plus souvent 2 ans), ou encore les besoins des réseaux contraints comme ceux des militaires ou des banques qui nécessitent de garantir contractuellement le service (contrairement à l’internet qui lui est dit de best effort, c’est-à-dire qui fait du mieux possible).

Face à ces difficultés, plusieurs solutions sont proposées.

Une première solution : une nouvelle version des protocoles de l’internet – IPv6

Le problème a été pris en compte il y a 15 ans avec le développement d’IPv6 (cf.

IPv6 sera-t-il la nouvelle version du protocole Internet ?), la nouvelle version de “l’Internet Protocol” prévue pour remplacer l’IPv4 que nous utilisons actuellement majoritairement.

L’idée était de permettre un très grand nombre d’adresses (340 milliards de milliards de milliards de milliards d’adresses) tout en conservant la base de la philosophie du réseau : un réseau en best effort ne nécessitant pas de se connecter avant de commencer un échange mais acheminant de façon autonome des petits paquets d’information. Cette idée, à l’œuvre dans tout l’internet, est issue des travaux d’une équipe française, Cyclade, qui était dirigée par Louis Pouzin. Des datagrammes (on parle aujourd’hui de paquets) circulant dans un réseau sans connexion préalable entre la source et la destination, constituait une véritable révolution par rapport aux réseaux “avec connexion” utilisés jusqu’alors.

L’idée était de permettre un très grand nombre d’adresses (340 milliards de milliards de milliards de milliards d’adresses) tout en conservant la base de la philosophie du réseau : un réseau en best effort ne nécessitant pas de se connecter avant de commencer un échange mais acheminant de façon autonome des petits paquets d’information. Cette idée, à l’œuvre dans tout l’internet, est issue des travaux d’une équipe française, Cyclade, qui était dirigée par Louis Pouzin. Des datagrammes (on parle aujourd’hui de paquets) circulant dans un réseau sans connexion préalable entre la source et la destination, constituait une véritable révolution par rapport aux réseaux “avec connexion” utilisés jusqu’alors.

IPv6 intègre également comme des options au sein du protocole ce qui n’était alors que des extensions parfois incompatibles entre elles et pas toujours mises en œuvre dans les routeurs. Ainsi, il deviendrait possible d’assurer la sécurité, la qualité de service ou la diffusion en multicast (un émetteur, plusieurs récepteurs comme ce qui existe en radio ou télévision) de bout en bout.

Enfin, IPv6 propose un protocole amélioré pour la mobilité permettant de communiquer avec un terminal mobile sans nécessairement repasser par sa base de départ. Mais le passage de la version 4 à la version 6 du protocole (la version 5 est une version spécifique dédiée à la diffusion en continue : le streaming) nécessite une cohabitation et la mise en place d’équipements adaptés. Le département du Commerce américain a ainsi chiffré à 25 milliards de dollars le coût du passage pour les seuls Etats-Unis. De plus en plus, des réseaux IPv6 ou mixte IPv4 et IPv6 voient le jour. La France est plutôt bien placée avec l’intégration d’IPv6 dans les Freebox depuis fin 2007 et la dernière réunion de standardisation des protocoles internet, l’IETF, qui a eu lieu fin mars, a fait l’objet d’une réunion spécifique sur la migration IPv6 au cours de laquelle Google a indiqué qu’il était entièrement compatible IPv6 et a appelé les autres sociétés participantes à accélérer la migration.

Une deuxième solution : un réseau de nouvelle génération - NGN

Mais si l’approche actuelle de l’internet permet une grande adaptabilité à de nombreux types de besoins, elle souffre en compensation d’une moindre optimisation. Les industriels des télécommunications ont cherché pour leur part à garantir contractuellement un niveau de qualité de service (QoS : Quality of Service) et donc des niveaux de services différents pour s’adapter aux besoins de certaines entreprises comme les banques. La notion de best effort à la base de l’internet n’étant pas assez sécurisée pour leurs besoins spécifiques. Ils ont proposé une autre alternative pour solutionner les difficultés actuelles du réseau en repartant d’une feuille blanche ou presque : le réseau de nouvelle génération (NGN : Next Generation Network). Il s’agit de prévoir un réseau commun pour les fixes et les mobiles. Ce réseau revient à la notion de connexion (on établit le chemin entre la source et la destination au début de la communication pour y passer plus rapidement tous les paquets) et de commutation (on s’intéresse à l’acheminement à l’intérieur d’un seul réseau avec ses adresses propres et non pas à l’acheminement complet dans un réseau de réseaux ce qui nécessite un bien plus grand champ d’adresses). Pour le reste, l’idée est de conserver au-dessus (pour aller de réseau en réseau) les paquets au format internet (IP) et surtout les adresses IP afin de conserver une compatibilité avec le réseau internet existant.

La compétition entre un réseau de routage IPv6 et le NGN (utilisant IPv6 pour sa signalisation - comme par exemple l’adressage) se joue donc sur la notion de avec ou sans connexion et de réseau optimisé ou de réseau adaptable. On comprendra que ce n’est pas sans incidences sur la neutralité du réseau puisque dans le cas des NGN il est plus facile de rendre certains flux prioritaires.

Quelques autres solutions pour certains des problèmes du réseau actuel

Outre ces deux grandes orientations, il existe par exemple des solutions adaptées aux réseaux d’objets. Dans ce cas, c’est la consommation énergétique qui prime, et les protocoles doivent être peu bavards pour économiser au mieux l’énergie. Le protocole Zigbee, par exemple est adapté aux réseaux locaux sans fils d’objets. Afin qu’un réseau local d’objets puisse s’insérer dans le réseau de réseaux que constitue l’internet, il a été proposé d’y ajouter des adresses Ipv6 à l’aide d’un protocole additionnel : 6lowPAN.

D’autres solutions se développent encore pour faire cohabiter plusieurs réseaux différents sur un même réseau physique, chacun utilisant une partie du temps (les routeurs virtuels avec par exemple le projet Geni comme l’expliquait Lawrence Landweber) ; ou bien pour permettre aux réseaux de s’autoconfigurer à partir d’objectifs définis par les humains et leur environnement (l’autonomic computing).

Une nouvelle solution : la remise à plat de la notion de réseau

Mais pour John Day, ces solutions ne sont que des palliatifs. Dans son livre, il reprend une idée émise dès 1972 par Bob Metcalfe, l’inventeur de l’Ethernet (à ne pas confondre avec l’Internet…) : “le réseau c’est de la communication interprocessus et seulement cela”.

La communication inter-processus (Inter-Process Communication, IPC) est un ensemble de mécanismes qui permettent d’échanger des données et de synchroniser des programmes en cours d’exécution. Ce changement de perspective, apparemment banal, a été qualifié par Brough Turner, responsable de la technologie chez NMS Communication de “rupture théorique fondamentale”. John Day, pour sa part explique que “la structure des réseaux apparaît plus simple que nous ne l’avions imaginée”. Que signifie alors ce passage d’une communication de données à une communication entre processus ?

Le fait de voir le réseau non plus comme un simple transport de données disposant d’une adresse de départ et une d’arrivée mais comme un mécanisme d’échange directement entre les programmes a une première conséquence : les données étant incluses dans un mécanisme entre les programmes plutôt que directement accessibles, le réseau offre une meilleure sécurité. Mais au-delà de cet aspect, un tel réseau offre une vision plus simple : les IPC permettent d’intégrer le mode connecté (utilisé dans les réseaux de télécommunication et dans le NGN) et le mode non connecté (utilisé dans les protocoles internet IPv4 et IPv6) sous la forme d’un seul modèle unique dont les deux précédents ne sont que des cas particuliers.

De plus, le modèle en plusieurs couches de l’internet ou des autres types de réseau, chacune n’étant pas toujours clairement délimitée, est remplacé par un seul mécanisme : les IPC. Il devient possible de créer des communications entre les processus d’une même machine, de machines sur le même réseau ou encore entre machines dans le même “réseau de réseaux”. Cette approche récursive permet d’avoir un même système quelle que soit la portée, tout en passant à l’échelle.

Enfin, un tel type de réseau distingue le nom d’une machine ou d’un processus sur cette machine (qui sert à identifier) de son adresse (qui sert à localiser). Une application (par exemple un navigateur sur une machine) peut alors appeler une autre application (par exemple un serveur Web sur une autre machine) par son nom. Le mécanisme de communication entre les processus établira alors une adresse qui lui sera propre. Cette approche permet de résoudre plus facilement les problèmes de mobilité (une application connue par son nom se trouve sur une machine qui ne se trouve pas forcément à l’adresse que l’on pense mais qui s’est déplacée entre temps : mieux encore l’application a pu changer de machine…). Mais la question du nommage est complexe car elle présente des enjeux politique : celui qui nomme les choses dispose d’un avantage important. Ainsi, le système de nommage proposé utilisera-t-il le DNS (Domain Name System, système de gestion des noms de domaine) pour permettre de localiser n’importe quelle ressource (on parle d’URI, Uniform Resource Identifier), comme le craint Stéphan Bortzmeyer ? Le DNS fait l’objet d’âpres combats et de luttes d’influence. Une autre solution serait de permettre l’utilisation d’espace de noms concurrents pour éviter le problème posé par un nom unique (cela compliquant par contre la gestion technique).

Ainsi, le passage à l’échelle des réseaux, la mobilité des terminaux ou encore la connexion d’une machine à plusieurs réseaux physiques (le multihoming), deviennent une conséquence même de la structure du réseau, et non plus une complication supplémentaire à ajouter aux réseaux de base. Un tel type de réseau serait alors plus simple tout en s’adaptant mieux à la taille toujours plus grande du réseau des réseaux.

La Pouzin Society

Un tel type de réseau pourrait-il se développer assez rapidement pour résoudre la crise de croissance actuelle de l’internet ? C’est ce que pensent un ensemble d’experts de l’IETF qui se sont réunis autour des idées proposées par John Day pour créer la Pouzin Society - un nom qui fait référence au français Louis Pouzin qui est à l’origine des notions de datagramme et de mode sans connexion, une innovation que John Day dans son livre, qualifie “d’inspirée. La première réunion du groupe s’est tenue les 4, 6 et 7 mai 2009, à Boston dans le cadre de l’exposition Future-Net sur les réseaux de nouvelle génération.

Un tel type de réseau pourrait-il se développer assez rapidement pour résoudre la crise de croissance actuelle de l’internet ? C’est ce que pensent un ensemble d’experts de l’IETF qui se sont réunis autour des idées proposées par John Day pour créer la Pouzin Society - un nom qui fait référence au français Louis Pouzin qui est à l’origine des notions de datagramme et de mode sans connexion, une innovation que John Day dans son livre, qualifie “d’inspirée. La première réunion du groupe s’est tenue les 4, 6 et 7 mai 2009, à Boston dans le cadre de l’exposition Future-Net sur les réseaux de nouvelle génération.

Il reste à voir le détail de ce que permet cette nouvelle architecture - mais également quels sont ses limites. Il faudra également des mises en œuvre permettant de valider les concepts. Cela pourrait être facilité par le fait que les IPC sont des mécanismes bien connus dans les systèmes d’exploitations des machines et qu’il existe beaucoup de mises en œuvres distribuées entre plusieurs machines (comme par exemple le système de gestion de fichiers en réseau NFS développé par Sun Microsystem).

Une des questions cruciale sera alors de savoir comment mettre en place des mécanismes de transition qui permettent de limiter les coûts voire même de les réduire rapidement si la nouvelle architecture, plus simple, permet de faire des économies. La possibilité de migrer à un coût acceptable mais également de faire cohabiter des réseaux IP et des nouveaux réseaux sera une clé indispensable pour assurer une approche de type “page blanche” comme celle proposée par la Pouzin Society ou encore celle proposée par les opérateurs avec le NGN. Enfin, il sera nécessaire d’accompagner cette nouvelle vision d’une campagne de formation et de sensibilisation. Encore quelques années et nous saurons quelle(s) solution(s) sera (seront) choisie(s) ou bien si la crise de l’internet aura belle et bien lieu…

Jean-Michel Cornu

Merci à Louis Pouzin, John Day, Guy Pujolle, Hubert Guillaud et Daniel Kaplan pour leur relecture et leurs commentaires.

neutralité du net, réseaux"Le président de la République actuel a un plan". C'est la première phrase du livre de François Bayrou, Abus de Pouvoir, et l'on peut la vérifier au moins en ce qui concerne le contrôle du net. Depuis la loi DADVSI où il était président de l'UMP et ministre de l'intérieur, Nicolas Sarkozy a déployé son plan pour contrôler le net. Il a commencé à l'appliquer avant-même la loi Hadopi, et prévoit de le parachever avec la Loppsi. Dans cet article exceptionnellement long, Numerama tente un décryptage du net selon Sarkozy.

[Lire la suite]Cela pourrait presque sembler anecdotique sur le continent américain, mais c’est en réalité particulièrement révélateur : la municipalité de Vancouver vient de publier dans son ordre de jour pour son prochain conseil municipal une liste de mesures destinées à adopter des standards ouverts (open data) ainsi que des logiciels open sources pour le traitement et la mise à disposition du public de ses données.

La ville souhaite créer ainsi de nouvelles opportunités en matière de service public en laissant ainsi les citoyens (développeurs, sous traitants, startups, partenaires, etc) créer de nouveaux services sur la base de ses données.

Où va la ville de Vancouver ?

La proposition qui a été soumise au conseil municipal pointe plusieurs motifs qui l’on poussé à adopter des technologies open source et des standards ouverts, tous sont centrés sur l’ouverture et la mise à disposition dans les conditions les plus ouvertes de partages (entendez hors copyrights) des données municipales, du code source developpé pour les traiter, et de l’exploration des possibles en matière de co-création de nouveaux services destinés à la relation au citoyen ou à la collaboration entre différentes administrations.

D’autres villes comme Washington DC, Portland et Toronto ont également exprimé leur intention d’adopter une politique ‘Libre’ pour leurs informations et leurs données, mais Vancouver est la première a avoir franchit le cap de l’inscription de cette volonté dans l’agenda de son conseil municipal.

Les problèmes liés à la transmission, à la réutilisation et aux licences de ces données ont fait reculer beaucoup de municipalités jusqu’ici, Vancouver semble avoir décidé de s’atteler à la résolution de ces problèmes afin de devenir la ville la plus ‘Libre’ du monde.

La France restera-t-elle une démocratie moderne (et indépendante) au XXIe siècle ?

Entre les programmes similaires au niveau fédéral mis en œuvre par le gouvernement de Barack Obama et ceux comme celui ci mis en place par une municipalité Canadienne, qui font de même sur un plan plus local, il est désormais évident que le système d’exploitation de la démocratie de demain est en train de s’écrire de l’autre coté de l’Atlantique.

A l’heure ou la France tourne le dos à l’internet, où son gouvernement et ses média martèlent (à l’exception notable mais inaudible de NKM) des messages de méfiance et de dénigrement vis à vis du web, il semble que nous allions tout droit vers un avenir où nous n’aurons d’autre choix que de rester au moyen âge ou de faire tourner le pays sur un système d’exploitation américain (la troisième voie consistant à bricoler pour s’apercevoir in fine que les coûts de maintenance et d’évolution rendent cette approche ridicule et dispendieuse).

Aucun gouvernement n’a en effet les moyens financiers d’aborder l’immense chantier de l’eDemocratie autrement que par de telles approches, surtout en période de crise. Faire tourner un ordinateur (par opposition à un pays) est, à coté, d’une relative simplicité. Or même sur ce terrain, seul Microsoft est encore en mesure d’aborder le problème avec une logique fermée et propriétaire (Apple y ayant renoncé lors de son passage à OSX, basé sur un Unix FreeBSD Libre), avec des budgets qui dépassent de loin ce qu’un pays comme la France peut se permettre d’y investir.

Lors d’une récente conversation avec Chris Heuer, le fondateur du Social Media Club, et Pierre Yves Platini, le fondateur de sa ‘filiale’ Française, nous ironisions sur ce fait en mettant en perspective le rôle du général Lafayette, un Français, véritable mythe aux USA, qui a largement contribué à définir la démocratie américaine à l’époque où la technologie de l’information qui dominait le monde était l’imprimerie. Il semble désormais évident qu’à l’époque de l’internet, le transfert de compétences risque fort d’être inversé.

Avec quelques dizaines de millions d’euros consacrés à des “projets web 2.0”, dont le “serious gaming” (et quelques centaines de millions pour améliorer l’infrastructure réseau, déja parmi les plus avancées au monde), on voit mal comment la France pourrait éviter de prendre, une fois de plus, un retard considérable dans le secteur du gouvernement 2.0 (si tant est que la vision du gouvernement pour l’avenir des réseaux se conjugue avec démocratie, ce qui est loin d’être une évidence).

Pour mieux mettre en contexte cette future rivalité Franco-Américaine, il est utile de rappeler que seule la France et les Etats Unis ont mis au point un système démocratique qu’ils considèrent, chacun de leur coté, comme universel.

En adoptant standards ouverts et open source, la solution américaine (au sens large, Etats-Unis Canada, en l’occurence) a toutes les chances d’être de facto le modèle dominant de l’eDemocratie de demain, or les principes fondateurs de la démocratie américaine seront gravés dans la conception même de ces logiciels, et la vision Française de la démocratie, elle, a toutes les chances de purement et simplement disparaître au XXIe siècle, un siècle où ‘vendre’ son modèle démocratique ne passera plus (que) par des ambassadeurs mais (aussi) par des informaticiens, et où les coûts associés à une telle mutation seront colossaux, disqualifiant de facto les approches fermés et propriétaires.

En abordant cet immense chantier avec de l’open source et des standards ouverts, l’Amérique a toutes les chances de rallier à elle d’autres nations soucieuses de préserver leur modèle démocratique dans une initiative open source internationale et institutionnelle, comme seule les universités ont jusqu’ici su en mettre en œuvre, réalisant, au passage, de substantielles économies sur le long terme (entendez par là au delà d’un mandat électoral).

Les positions de la France à ce sujet sont pour l’instant relativement floues mais à aucun moment il n’a été fait mention de l’adoption de standard ouverts, et encore moins de mise à disposition massive du public des données en provenance de l’administration. Quand à l’adoption de l’open source, nos décideurs politiques ont récemment eu l’occasion de démontrer à quel point ils maitrisaient le sujet.

En Nouvelle Zélande, un pays qui est, dans son approche de l’internet, très proche de la France (filtrage des informations disponibles, contrôle des réseaux, surveillance de la population…), les développement de type ‘eDemocratie’ sont fait avec des technologies fermées Microsoft et il n’est pas du tout prévu de mettre quoi que ce soit à la disposition du public, en dehors de services d’eAdministration classiques (un concept totalement dépassé lancé par Lionel Jospin à la fin du XXe siècle).

Deux approches du service public et de l’eDemocratie

Les seules avancées - pour l’instant à l’état d’annonce - du gouvernement Français en matière d’eDemocratie, sont l’arrivée sous peu d’un service payant par téléphone permettant aux Français d’interagir plus facilement avec l’administration pour avoir accès à ses données. Cette façon de voir les choses est radicalement opposée à l’approche américaine et risque fort, tout en étant très caractéristique de l’approche ‘intégrée’ et régalienne à la Française, de montrer rapidement ses limites. Elle n’est pas sans rappeler l’impasse intellectuelle du ‘portail’, imaginé par les média dans les années 90, qui pensaient ainsi que se doter d’un site web fait à partir de leur modèle suffirait pour passer le cap, sans avoir à repenser en profondeur ce modèle, lui aussi hérité de Gutenberg.

Outre qu’elle fasse payer les citoyens pour accéder à de l’information publique, dans l’un des pays où les coûts de l’appareil d’état sont l’un des plus élevés au monde, l’approche Française consiste à faire évoluer l’administration, et de réduire ainsi la vision de l’eDemocratie à celle d’une interface supplémentaire entre l’administration et les citoyens.

L’approche américaine est tout autre. En mettant à disposition l’ensemble des ses données ainsi que le code qui les gère, ce n’est pas le citoyen de base qui est visé, mais plutôt des intermédiaires qui auront la charge de construire les services que la France, en tant qu’Etat, tente de mettre en œuvre. D’un coté comme de l’autre de l’Atlantique, on n’a clairement pas la même vision de la démocratie de demain (et Lafayette se retourne dans sa tombe).

Alors, où se situe la différence ?

En matière de coûts pour le citoyen ? Par sûr. Le service téléphonique d’eAdministration Français sera payant, aux dernières nouvelles (0,12€/min), et les services construits sur un mode ‘mashup’ par des sociétés privés, des états ou des municipalités américaines ont toutes les chances de l’être également (bien que l’on peut s’attendre à pas mal de solutions de monétisation alternatives).

En matière d’innovation ? A coup sûr. Là où l’innovation est exclusivement du coté de l’Etat en France, celle-ci est largement laissée au privé de l’autre coté de l’Atlantique (au sens large, les fondations, ONG et autres non profit se ruent actuellement sur ce secteur). Le résultat sera, à coup sûr, la création d’un écosystème d’innovations autour des données des administrations publiques. On peut s’attendre à voir le même phénomène que celui qui a accompagné l’adoption de standards ouverts et de l’open source dans le monde de l’internet. Derrière Yahoo et Google, par exemple, se trouve un riche écosystème d’innovations qui a donné naissance à une multitude de startups proposant des services innovants, que ces géants étaient bien incapables de faire éclore en leur sein. C’est ce type de dynamique que souhaite voir apparaître les différentes administrations nord américaines en se lançant dans de tels programmes, et c’est une dynamique qui ne verra pas le jour en France.

Là où la France informatise et internetise une administration conçue à l’âge de l’imprimerie, les USA et le Canada conçoivent un système d’exploitation radicalement nouveau, destiné à mettre en place un écosystème au sein duquel est censé éclore de nouveaux modes de relation entre Etat et citoyens (ou d’autres choses, comme les relations entre Etats et entreprises, la collaboration inter administrative, vraisemblablement à terme inter Etats, etc). La conception des ‘logiciels’, c’est à dire l’eAdministration, n’est pas vraiment - dans l’approche américaine - du ressort de l’Etat.

Libéralisme ? Oui, c’est certain, l’approche américaine de l’eAdministration, largement crowdsourcée sur la base d’une eDemocratie (notez la différence : applicatif vs. système d’exploitation), est une vision très libérale du rapport entre démocratie et citoyen, mais l’approche Française, si elle a le mérite (est-ce un mérite ?) de repousser le libéralisme Yankee, bloque de facto toute innovation (à moins de considérer que la centralisation est propice à l’innovation, ce qui n’a jamais été démontré jusqu’ici, cf. Quaero et autres initiatives désastreuses se basant sur ce principe).

Au final, à l’heure ou le libéralisme économique est largement remis en cause partout sur la planète, c’est une autre forme de libéralisme qui se fait jour, et surprise, sont bras armé s’appelle Open Source et philosophie du Libre. Une gifle pour ceux qui pensaient voir dans la philosophie du partage de l’abondance numérique une résurgence Marxiste à combattre d’urgence. Les préjugés d’hier on décidément bien du mal à s’appliquer aux réalités d’aujourd’hui.

Si cette opposition résultait d’une divergence de vues entre les deux Etats qui ont servit de modèle à la plupart des démocraties du XXe siècle, on pourrait se perdre dans des débats sans fin, mais la triste réalité est plutôt une opposition entre une vision initiée par Obama et qui s’écrit sous nos yeux, et une cécité totale des dirigeants Français (toutes tendances confondues) face aux enjeux et aux potentiels qu’offrent la technologie et son arrivée brutale dans le champ démocratique.

Les média ont souffert d’une telle cécité quand les technologies sont arrivées dans leur champ de vision, et l’on voit aujourd’hui où cela les a mené. L’industrie culturelle également. Si ces deux derniers peuvent passer par des phases de destruction créatrice sans remettre en question l’avenir de l’humanité, il en est tout autrement de la démocratie.

L’Europe (encore elle) contredit l’approche Française

L’autre point soulevé, lors d’un diner avec les dirigeants du Social Media Club, est la différence de maturité entre l’Europe et l’Amérique dans la construction d’un supra-etat fédéral (au sens d’un futur supra-état USA-Canada-Mexique) : alors que l’Europe en est à ses balbutiements, les Etats-Unis sont un état fédéral mature depuis bien longtemps et ont accumulé deux cents ans d’expériences (et de déconvenues) en la matière.

L’approche Française dans la construction, non pas d’une eDémocratie mais - à défaut - d’une eAdministration, n’a pas d’avenir dans une Europe où la nécessité d’une uniformisation, et plus encore d’une interopérabilité sera un nécessaire socle fondateur à une eDemocratie Européenne, le récent mouvement coordoné (ou spontané, allez savoir) des Etats-Unis et du Canada devrait ici servir, si ce n’est de leçon, du moins de signal d’alerte. Les développements en cours, dans une perspective Européenne à long terme, sont destinés à devenir obsolètes et caduques, là où l’approche américaine prend en compte - ne serait ce que par l’adoption de standards ouverts - cette dimension du problème.

Pire encore (ou mieux, c’est selon), les développements américains sont - par la nature même de l’open source - appelés à se développer ailleurs que sur le continent Américain, avec deux effets concomitants : une baisse des coûts de développement (ou tout du moins un partage de ceux-ci) pour l’Amérique du nord, et une interopérabilité mondiales des eDémocraties construites sur cette base. Là encore, la France risque de se retrouver sur le coté de la route - si c’est encore demain une démocratie moderne, c’est à dire si son modèle démocratique à réussi à faire la douloureuse transition entre Gutenberg et internet. Autant dire que c’est très mal parti.

Au final, on trouve derrière les enjeux de l’eDemocratie, une certaine constance de la part des Etats-Unis et de la France qui proposent, chacun de leur coté, deux visions radicalement opposées de l’avenir de la démocratie : Libre et ouverte pour l’un, surveillées, contrôlée et verouillée pour l’autre, mais les deux pays ont au moins ce mérite d’être, chacun dans son genre, à l’avant garde de l’innovation. Open Source d’un coté, Hadopi et Loppsi de l’autre, les deux approches sont aujourd’hui observées par de nombreuses démocraties dans le monde qui se demandent où se site leur avenir et quel modèle adopter. Une rivalité vieille de plus de deux cents ans, finalement, mais avec des modèles qui divergent de plus en plus.

A lire sur le même thème :

- Les USA et l’Angleterre se disputent la pole position de l’eDemocratie

- La Chine censure Twitter, Flickr, Blogger, Hotmail, Bing…

- Rebondissements dans l’affaire opposant la député Sylvia Pinel et le blog deputesgodillots.info

- Un rapport souligne l’inefficacité des mesures de filtrages à venir sur internet

- Read-Write-Government : la crise de la démocratie vue par Lawrence Lessig

No related posts.

Related posts brought to you by Yet Another Related Posts Plugin.

Depuis quelques semaines, nombreux étaient ceux qui étaient impatients de poser des questions à Wolfram Alpha (WA). Sur la page Facebook ou sur le blog de WA les espérances et l'excitation des internautes étaient palpables. On sav...

Ce jeune coréen vient de réaliser une jeune fille en 3D à l'aide de 3dsmax, mental ray, Photoshop et Zbrush, assez hallucinante de réalisme, vous trouvez pas?

Si vous souhaitez en savoir plus, je vous laisse découvrir le making of de cette création.

Découvert chez Hebiflux

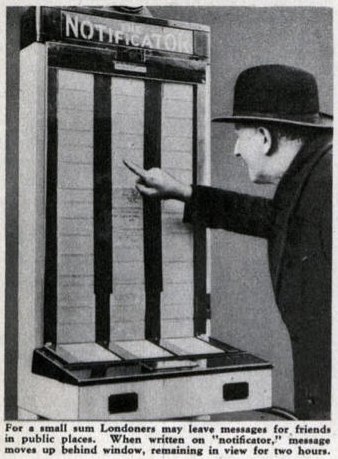

Alors que Twitter est toujours le sujet le plus chaud de la blogosphère, cette image d’archive nous apprend que le principe du microblog existait déjà en 1935 :

Le “Notificator” était une sorte de distributeur automatique de messages : les clients inséraient une pièce puis pouvaient rédiger un court message qui était ensuite affiché derrière la vitre pendant au moins deux heures avant d’être remplacé par les autres.

Ces machines étaient implantées à Londres dans les lieux publics (restaurants, gares…) et servaient à ceux qui voulaient diffuser des messages publics ou annuler un RDV (biens sûr il fallait que la personne concerné par ce RDV annulé ai la présence d’esprit de regarder les messages).

Eux au moins ils avaient un modèle économique ! Mais ça ne les a pas empêché de disparaître…

(via @Mickou)

Sublime vidéo illustrant en mouvement le projet artistique Scratching The Surface que l'on doit à Alexandre Farto Aka Vhils sur un fond de musique signée Gustavo Santaolalla (iguazu - Ronroco)...

Vu sur Notcot